Stable Diffusion 本地绘图环境配置教程

从安装环境、下载模型到生成第一张图,ComfyUI / WebUI / Stability Matrix 一次讲清楚

| 发布说明:本文正文标题层级已按网站发布习惯设置:一级标题使用 H2,二级标题使用 H3。 |

文章摘要

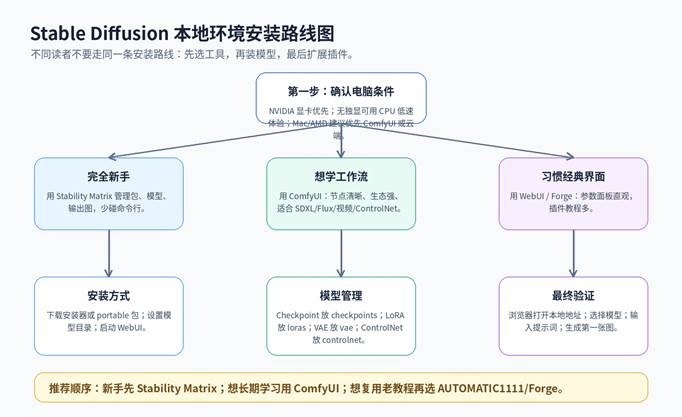

Stable Diffusion 本地绘图环境配置,核心不是“把所有工具都装一遍”,而是根据电脑配置和使用目标选择合适路线:完全新手可以从 Stability Matrix 入门,想长期学习工作流建议选择 ComfyUI,习惯经典参数面板可以选择 AUTOMATIC1111 或 Forge。本文会从硬件准备、工具选择、安装步骤、模型目录、插件扩展、GPU 优化到常见报错排查,完整梳理一套可落地的本地 AI 绘图环境搭建方案。

目录导航

- 为什么要本地部署 Stable Diffusion

- 先选路线:Stability Matrix、ComfyUI、WebUI 怎么选

- 安装前准备:系统、显卡、硬盘、模型来源

- Windows 新手路线:Stability Matrix 一键管理

- ComfyUI 本地安装与工作流配置

- AUTOMATIC1111 / Forge 安装配置

- 模型目录:Checkpoint、LoRA、VAE、ControlNet 放哪里

- 生成第一张图:参数、提示词与采样设置

- 插件、自定义节点与常见扩展

- GPU、CUDA、显存与性能优化

- 常见报错排查

- FAQ、相关阅读与 SEO 文档

为什么要本地部署 Stable Diffusion

Stable Diffusion 是一类可在本地运行的开源图像生成模型生态。与网页版绘图工具相比,本地部署的优势是可控性更强、模型可自由切换、LoRA 和 ControlNet 等扩展更灵活,也更适合批量生成、电商素材、角色一致性、风格化封面图和私有项目。

但本地部署也有门槛:显卡显存、Python 环境、模型文件、插件依赖、CUDA/PyTorch 版本,都可能影响是否能顺利出图。因此,新手最需要的不是“最强工具”,而是一条不会轻易装崩的路线。

适合本地部署的人群

- 想长期做 AI 绘画、封面图、短视频分镜、电商主图、角色设定的创作者。

- 需要使用 LoRA、ControlNet、IP-Adapter、工作流节点等高级能力的进阶用户。

- 希望在离线或半离线环境中测试模型,减少对云端平台依赖的用户。

- 有 NVIDIA 显卡,想充分利用本机 GPU 算力的人。

不适合本地部署的情况

- 电脑没有独立显卡,或者硬盘空间非常紧张。

- 只是偶尔生成几张图,不想维护模型和插件。

- 完全不能接受命令行、报错排查和版本管理。

- 需要商业合规使用但不愿意核对模型许可证、素材来源和平台规则。

| 一句话建议:如果你是新手,先用 Stability Matrix 管理环境;如果你想长期玩工作流,直接学 ComfyUI;如果你只想跟老教程复现参数,可以选择 AUTOMATIC1111 或 Forge。 |

先选路线:Stability Matrix、ComfyUI、WebUI 怎么选

Stable Diffusion 的“安装环境”不是单一软件,而是由运行界面、模型文件、Python/PyTorch 环境、插件扩展和输出目录组成的一套系统。

| 路线 | 推荐指数 | 适合场景 | 安装难度 |

| Stability Matrix | ★★★★★ | 新手、一台电脑管理多个 WebUI、统一模型目录 | 低 |

| ComfyUI | ★★★★★ | 工作流、ControlNet、SDXL/Flux/视频节点、长期学习 | 中 |

| AUTOMATIC1111 | ★★★★ | 经典文生图/图生图、老教程复现、插件生态 | 中 |

| Forge / reForge | ★★★★ | 低显存优化、WebUI 风格、喜欢传统界面 | 中 |

| Fooocus / InvokeAI | ★★★☆ | 快速出图、封装式体验、少调参数 | 低到中 |

新手默认推荐:Stability Matrix + ComfyUI

Stability Matrix 可以理解为“AI 绘图工具管理器”,适合下载、安装和更新 ComfyUI、AUTOMATIC1111、Forge、Fooocus、InvokeAI 等 WebUI,同时管理模型和输出图片。它能减少新手在 Git、Python 和目录配置上的阻力。

ComfyUI 更像“AI 绘图工作流编辑器”。每一步生成流程都用节点连接表示,虽然初看复杂,但它在 SDXL、Flux、视频生成、局部重绘、ControlNet、IP-Adapter、批处理等场景中更灵活。

仍然可以选择 WebUI / Forge 的场景

如果你看的是老教程、需要经典的 txt2img / img2img / extras / extensions 面板,AUTOMATIC1111 仍然有价值。Forge 或 reForge 一类分支则常被用于显存优化或新版模型兼容,但不同分支的维护状态会变化,下载前要看官方仓库最近更新时间和说明。

安装前准备:系统、显卡、硬盘、模型来源

电脑配置建议

| 配置项 | 最低可尝试 | 推荐配置 | 说明 |

| 系统 | Windows 10/11、macOS、Linux | Windows 11 + NVIDIA 显卡 或 Linux 服务器 | 新手优先 Windows;进阶可用 Linux。 |

| 显卡 | NVIDIA 4GB 显存 | NVIDIA 8GB/12GB/16GB+ 显存 | 显存越大,可用分辨率、模型和批量越高。 |

| 内存 | 16GB | 32GB+ | 模型加载、节点缓存和浏览器都会占内存。 |

| 硬盘 | 50GB 可体验 | 200GB+ SSD | 模型、LoRA、ControlNet、输出图会快速占满硬盘。 |

| 网络 | 可访问模型源 | 稳定下载大文件 | 单个模型通常 2GB-15GB。 |

显卡选择原则

- NVIDIA 显卡是本地 Stable Diffusion 最省心的选择,尤其是 RTX 3060 12GB、RTX 4060 Ti 16GB、RTX 4070/4080/4090 以及更新型号。

- AMD 显卡可以尝试 DirectML、ROCm 或专门分支,但新手排错成本更高。

- Apple Silicon Mac 可以跑部分工具和模型,但速度、插件兼容和显存共享机制与 Windows NVIDIA 路线不同。

- CPU 也能跑,但速度通常很慢,只适合验证流程,不适合长期生产。

模型来源与安全提醒

模型文件建议优先来自 Hugging Face、Stability AI 官方页面、Civitai 等知名社区,并注意许可证、商业使用限制和作者说明。下载整合包时要警惕未知脚本、自动启动文件和来历不明的插件。

| 安全建议:不要随便运行陌生整合包里的 .bat、.exe、.ps1 脚本;不要把私密照片、身份证件、人脸素材交给来历不明的模型或插件处理。 |

Windows 新手路线:Stability Matrix 一键管理

适用场景

- 你不想手动配置 Python、Git、虚拟环境。

- 你想同时体验 ComfyUI、WebUI、Forge、Fooocus 等多个工具。

- 你希望统一管理模型目录,避免每个工具重复下载同一份模型。

安装步骤

- 进入 Stability Matrix 官方页面或 GitHub Releases,下载 Windows 安装包或便携版本。

- 安装或解压后启动,选择一个空间充足的磁盘作为数据目录。

- 在 Packages 中选择 ComfyUI 或 Stable Diffusion WebUI / Forge,点击安装。

- 在 Model Browser 或模型管理页下载基础模型,或把已有 .safetensors / .ckpt 文件导入模型目录。

- 启动对应 WebUI,等待控制台完成依赖安装,浏览器自动打开本地地址。

- 选择模型、输入提示词,先用 512×512 或 768×768 低分辨率生成第一张图。

新手推荐设置

| 项目 | 推荐值 | 原因 |

| 安装盘 | 非系统盘,剩余 200GB+ | 模型和输出图占用很快增长。 |

| 首选包 | ComfyUI | 更新活跃、工作流生态强。 |

| 首个模型 | SD 1.5 或 SDXL Base | 教程多,兼容性相对好。 |

| 图片尺寸 | 512×512 / 768×768 | 先验证环境,避免显存不足。 |

| 批量数量 | 1 | 新手先不要批量生成。 |

ComfyUI 本地安装与工作流配置

ComfyUI 推荐安装方式

ComfyUI 目前适合长期学习 Stable Diffusion 工作流。Windows 用户可使用 Desktop App、Windows Portable Package 或 Stability Matrix 安装;进阶用户可以手动 Git 克隆并用 Python 虚拟环境运行。

| 方式 | 适合人群 | 优点 | 注意点 |

| Desktop App | 新手 | 安装简单,官方入口清晰 | 功能和插件路径需按桌面版逻辑理解。 |

| Windows Portable | Windows NVIDIA 用户 | 解压即用,便携,Python 内置 | 路径不要有中文,建议放 SSD。 |

| Stability Matrix | 多工具用户 | 统一管理包和模型 | 部分更新由管理器控制。 |

| 手动安装 | 开发者 | 可控性强,方便调试 | 需要懂 Python、Git、依赖管理。 |

手动安装示例

git clone https://github.com/comfyanonymous/ComfyUI.git

cd ComfyUI

python -m venv venv

venv\Scripts\activate

python -m pip install –upgrade pip

pip install -r requirements.txt

python main.py

如果是 Linux/macOS,把激活命令改成 source venv/bin/activate。Windows Portable 用户一般不需要自己创建 venv。

ComfyUI Manager 与自定义节点

ComfyUI 的强大来自自定义节点生态。新版 ComfyUI 通常已经内置或支持 Extensions / Manager 入口;如果没有,可以通过克隆 ComfyUI-Manager 到 custom_nodes 目录后安装依赖。

cd ComfyUI/custom_nodes

git clone https://github.com/Comfy-Org/ComfyUI-Manager comfyui-manager

cd comfyui-manager

pip install -r requirements.txt

安装自定义节点后,如果工作流提示“missing custom nodes”,优先使用 Manager 的 Install Missing Custom Nodes 功能;如果仍失败,再看控制台提示缺哪个 Python 包。

AUTOMATIC1111 / Forge 安装配置

AUTOMATIC1111 经典安装步骤

AUTOMATIC1111 Stable Diffusion WebUI 的经典 Windows 安装思路是:安装 Python 3.10.6、安装 Git、克隆仓库、运行 webui-user.bat。它的优势是教程数量多,缺点是对 Python/PyTorch 版本更敏感。

git clone https://github.com/AUTOMATIC1111/stable-diffusion-webui.git

cd stable-diffusion-webui

webui-user.bat

常用启动参数

| 参数 | 用途 | 说明 |

| –xformers | 尝试启用显存优化 | 不适合所有显卡和版本,报错时可移除。 |

| –medvram | 中等显存优化 | 6GB-8GB 显存可尝试。 |

| –lowvram | 低显存模式 | 速度会明显下降。 |

| –listen | 允许局域网访问 | 要配合防火墙和安全设置。 |

| –api | 启用 API | 给脚本或其他工具调用 WebUI。 |

Forge / reForge 的定位

Forge / reForge 一类项目通常基于 WebUI 交互习惯,加入显存管理、性能或新模型兼容方面的改动。适合已经熟悉 AUTOMATIC1111,但希望更顺畅加载 SDXL、Flux 或低显存优化的用户。

| 版本提醒:WebUI/Forge 分支更新节奏会变化,下载前优先看 GitHub 仓库的 README、Releases 和 Issues,不建议照搬一两年前的命令。 |

模型目录:Checkpoint、LoRA、VAE、ControlNet 放哪里

常见模型类型解释

| 模型类型 | 常见文件 | 作用 | 新手说明 |

| Checkpoint | *.safetensors / *.ckpt | 基础大模型,决定整体画风和能力 | 先下载一个 SD1.5 或 SDXL 基础模型即可。 |

| LoRA | *.safetensors | 风格、角色、服装、动作等轻量微调 | 需要在提示词中触发或在节点中加载。 |

| VAE | *.safetensors / *.pt | 影响色彩、细节和画面观感 | 图像发灰、发黑时可尝试更换。 |

| ControlNet | *.safetensors | 姿势、边缘、深度、线稿等控制 | 通常需要预处理器和对应模型。 |

| Embedding / TI | *.pt / *.bin | 提示词嵌入 | WebUI 老生态中常见。 |

推荐目录管理方法

- 优先使用 .safetensors 格式,安全性和社区兼容性更好。

- 模型文件名保留模型版本、尺寸、量化信息,例如 sdxl-base-1.0.safetensors。

- 不要把模型散放在桌面、下载目录和多个 WebUI 子目录里。

- 使用 Stability Matrix 时,尽量配置共享模型目录,避免重复占用硬盘。

生成第一张图:参数、提示词与采样设置

最小可用参数模板

| 参数 | 建议值 | 说明 |

| 模型 | SD 1.5 或 SDXL 基础模型 | 先用基础模型验证环境。 |

| Prompt | a cute cat, soft light, detailed, high quality | 先用英文短提示词测试。 |

| Negative Prompt | low quality, blurry, bad anatomy | 避免低质量、模糊、错误结构。 |

| 尺寸 | 512×512 / 768×768 / 1024×1024 | 显存不足先降尺寸。 |

| Steps | 20-30 | 越高越慢,不一定越好。 |

| CFG | 5-8 | 提示词控制强度。 |

| Sampler | Euler a / DPM++ 2M Karras | 常用采样器,稳定易测。 |

| Batch Size | 1 | 新手先不要开批量。 |

第一张图失败时怎么判断

- 如果控制台还在下载依赖,不要反复点击生成,等待安装完成。

- 如果报 CUDA out of memory,先把分辨率降到 512×512,Batch Size 改成 1。

- 如果模型列表为空,先确认模型放对目录,再刷新模型列表或重启工具。

- 如果浏览器打不开,先看控制台显示的本地地址,通常是 127.0.0.1:7860 或 127.0.0.1:8188。

插件、自定义节点与常见扩展

ComfyUI 常用扩展方向

- ComfyUI Manager:管理自定义节点、安装缺失节点、更新扩展。

- ControlNet / T2I-Adapter:控制姿势、边缘、深度、线稿等结构。

- IP-Adapter:参考图风格、角色和构图迁移。

- Upscale 节点:高清放大和细节增强。

- 视频/动画节点:图像转视频、帧间插值、工作流批处理。

WebUI 常用扩展方向

- sd-webui-controlnet:经典 ControlNet 扩展。

- adetailer:自动局部细节修复,常用于人脸和手部。

- tagger / prompt tools:反推标签、提示词辅助。

- image browser:管理生成图片和参数。

| 扩展安装原则:一次只装一个扩展,装完重启并测试;不要一口气安装几十个插件,否则出错很难定位。 |

GPU、CUDA、显存与性能优化

是否必须手动安装 CUDA

多数整合包、Portable 包或 WebUI 自动安装流程会安装与 PyTorch 匹配的 CUDA 运行库;普通用户不一定需要单独安装完整 CUDA Toolkit。只有你需要编译扩展、开发 CUDA 程序、训练模型或手动管理 PyTorch 版本时,才更需要关注系统级 CUDA Toolkit。

显存不足的优化顺序

- 把分辨率降到 512×512 或 768×768。

- Batch Size 改成 1,Batch Count 可以慢慢增加。

- 换小模型:SD 1.5 通常比 SDXL 省显存。

- 启用工具内的低显存参数或显存优化选项。

- 关闭不必要的 ControlNet、高清修复、放大、批量节点。

- 升级显卡或把高显存流程迁移到云端 GPU。

基础验证命令

nvidia-smi

python -c “import torch; print(torch.cuda.is_available()); print(torch.version.cuda); print(torch.cuda.get_device_name(0))”

如果 nvidia-smi 能显示显卡,但 PyTorch 显示 False,通常是 PyTorch CUDA 版本、驱动版本或虚拟环境装错。不要在同一个环境里反复混装不同来源的 torch。

常见报错排查

报错:Torch is not able to use GPU

- 先运行 nvidia-smi,确认驱动识别显卡。

- 确认当前 Python 环境里的 torch 是 CUDA 版,不是 CPU 版。

- 不要同时混用 pip、conda、整合包自带 Python。

- 必要时删除 venv 目录,让 WebUI 重新创建依赖环境。

报错:CUDA out of memory

- 降低分辨率和 batch size。

- 关闭 Hires.fix、ControlNet、多 LoRA、高分辨率放大节点。

- 尝试低显存参数,或换更小的模型。

- 重启 WebUI,释放残留显存。

报错:No module named xformers

这类报错不一定会导致不能出图。xformers 是一种显存/速度优化相关依赖,如果工具可正常生成,可以先不处理。只有在确实需要启用时,再按对应 WebUI 文档重新安装兼容版本。

报错:缺失 ComfyUI 节点

打开 ComfyUI Manager,使用 Install Missing Custom Nodes;如果节点安装后仍然红色,查看控制台缺哪个依赖包,再进入对应节点目录安装 requirements.txt。

安全合规与素材版权

本地部署不等于可以随意商用

Stable Diffusion 生态中的基础模型、LoRA、ControlNet、风格模型和工作流,可能各自有不同许可证。商用前应逐一核对模型页面的授权范围,尤其是人物肖像、品牌 Logo、受版权保护角色和训练数据来源不明的模型。

建议避免的用途

- 未经同意生成真实人物的敏感、侮辱性或误导性图像。

- 冒充他人、制造虚假证据、仿冒品牌或用于诈骗。

- 把未授权模型生成结果直接用于商业包装、广告或售卖。

- 下载和运行来历不明的插件、整合包或可执行文件。

FAQ

Stable Diffusion 本地部署一定要 NVIDIA 显卡吗?

不是绝对必须,但 NVIDIA 显卡最省心。AMD、Apple Silicon、CPU 都有路线,但插件兼容、速度和排错成本通常更高。

新手应该先装 ComfyUI 还是 WebUI?

推荐先用 Stability Matrix 安装 ComfyUI。ComfyUI 是当前更适合长期学习的工作流路线,WebUI 更适合复现旧教程和传统参数面板。

Python 应该装哪个版本?

AUTOMATIC1111 经典文档仍常见 Python 3.10.6 口径;ComfyUI Portable 或 Stability Matrix 通常会自带环境,新手不建议随意升级 Python。

为什么模型下载后不显示?

通常是目录放错、文件没下载完整、后缀不对或工具没刷新。把模型放到对应 checkpoints / Stable-diffusion 目录后重启或刷新。

LoRA 怎么使用?

WebUI 中通常通过 LoRA 面板或提示词触发;ComfyUI 中一般需要 LoRA Loader 节点连接到模型。不同 LoRA 页面会说明触发词和推荐权重。

显存 4GB 能玩吗?

可以尝试 SD1.5 小图低参数,但体验有限。SDXL、高清修复、多 ControlNet、视频工作流基本会吃紧。

本地部署会不会泄露图片?

本地生成本身不需要把提示词和图片上传到云端,但下载模型、插件、使用在线节点或第三方扩展时仍可能联网。

商用图片需要注意什么?

必须看基础模型、LoRA、素材、字体、角色和品牌元素的授权。不要默认所有开源模型都可无条件商用。

官方参考来源

| 来源 | 链接 |

| ComfyUI 官方仓库 | https://github.com/Comfy-Org/ComfyUI |

| ComfyUI Windows Portable 官方文档 | https://docs.comfy.org/installation/comfyui_portable_windows |

| ComfyUI 自定义节点安装文档 | https://docs.comfy.org/installation/install_custom_node |

| AUTOMATIC1111 Stable Diffusion WebUI 官方仓库 | https://github.com/AUTOMATIC1111/stable-diffusion-webui |

| AUTOMATIC1111 NVIDIA GPU 安装说明 | https://github.com/AUTOMATIC1111/stable-diffusion-webui/wiki/Install-and-Run-on-NVidia-GPUs |

| Stable Diffusion WebUI Forge 官方仓库 | https://github.com/lllyasviel/stable-diffusion-webui-forge |

| Stability Matrix 官方仓库 | https://github.com/LykosAI/StabilityMatrix |

| Stability Matrix 官网 | https://lykos.ai/ |

| Stability AI – Stable Diffusion 3.5 | https://stability.ai/news-updates/introducing-stable-diffusion-3-5 |

| PyTorch 本地安装选择器 | https://pytorch.org/get-started/locally/ |

| NVIDIA CUDA Windows 安装指南 | https://docs.nvidia.com/cuda/cuda-installation-guide-microsoft-windows/ |

| NVIDIA CUDA Linux 安装指南 | https://docs.nvidia.com/cuda/cuda-installation-guide-linux/ |