《CUDA、cuDNN、显卡驱动安装配置教程》

从驱动安装到深度学习框架验证,新手也能搭好 GPU 加速环境

适用场景:AI 编程环境搭建 / 本地大模型 / PyTorch / TensorFlow / Stable Diffusion / 推理服务

文章摘要

CUDA、cuDNN 和 NVIDIA 显卡驱动是本地 AI 环境里最容易装错、也最容易互相冲突的三件套。很多新手看到 nvidia-smi 里显示 CUDA Version,就以为 CUDA 已经安装成功;也有人先装 CUDA、后装驱动,最后导致 PyTorch 或 TensorFlow 检测不到 GPU。本文用保姆级流程拆解显卡驱动、CUDA Toolkit、cuDNN、Python 环境、深度学习框架之间的关系,并分别给出 Windows、Linux、WSL2 和 Docker 场景下的安装步骤、验证命令和常见报错解决方案。

| 适合人群:刚开始做 AI 编程、本地部署大模型、训练/推理深度学习项目,或者正在解决 torch.cuda.is_available() 返回 False 的读者。 |

目录

一、先搞懂三者关系:驱动、CUDA、cuDNN 各管什么

二、安装前检查清单:显卡、系统、Python、框架版本

三、Windows 安装流程

四、Linux 服务器安装流程

五、WSL2 与 Docker 场景

六、PyTorch / TensorFlow 验证

七、常见问题排查

八、FAQ、相关阅读与 SEO 文档

一、先搞懂:显卡驱动、CUDA、cuDNN 到底是什么

在 AI 环境配置中,最常见的误区是把“驱动”“CUDA”“cuDNN”看成一个东西。实际上它们分别处在不同层级:显卡驱动负责让操作系统识别并调度 NVIDIA GPU;CUDA Toolkit 提供 GPU 编程和运行时开发工具;cuDNN 是针对深度神经网络的加速库,通常由 TensorFlow、PyTorch、推理框架或 pip/conda 包间接使用。

| 组件 | 主要作用 | 什么时候必须装 | 常见验证方式 |

| NVIDIA 显卡驱动 | 让系统识别 GPU,并提供 CUDA Runtime 所需的底层驱动能力。 | 只要想让 AI 框架使用 NVIDIA GPU,就必须先装。 | nvidia-smi |

| CUDA Toolkit | 包含 nvcc、CUDA 库、开发头文件、示例、调试/分析工具。 | 需要编译 CUDA 扩展、开发 GPU 程序、部分软件明确要求本地 Toolkit 时必须装。 | nvcc –version |

| cuDNN | 深度神经网络加速库,常用于卷积、RNN、注意力相关底层运算。 | TensorFlow、部分推理/训练框架需要;有些 pip 包会自带所需依赖。 | 框架 GPU 验证命令 |

| PyTorch / TensorFlow | 真正执行训练、推理、张量计算的上层框架。 | AI 项目运行时必须安装。 | torch.cuda.is_available() / tf.config.list_physical_devices |

| 关键提醒:nvidia-smi 里显示的 CUDA Version 表示当前驱动最高兼容的 CUDA 运行时能力,不等于你已经安装了 CUDA Toolkit。要判断 Toolkit 是否安装,应运行 nvcc –version。 |

二、安装前检查清单:先确认这 5 件事

- 显卡型号:确认是 NVIDIA 独显或服务器 GPU;Intel/AMD 显卡不能使用 CUDA。

- 操作系统:Windows 11/10、Ubuntu/Rocky/CentOS、WSL2 路线要分开看。

- 驱动分支:个人电脑可选 Game Ready 或 Studio Driver;AI 创作/开发更建议稳定优先。

- 框架版本:PyTorch、TensorFlow、vLLM、ComfyUI 等可能绑定不同 CUDA 版本。

- Python 环境:强烈建议使用 venv、conda 或 uv 隔离项目环境,不要把所有包装进系统 Python。

三、版本怎么选:不要盲目追最新

新手最稳的选择不是“所有组件都装最新”,而是“按你的 AI 框架支持矩阵选择”。例如 PyTorch 通常提供预编译的 CUDA 版安装命令,你只要按官网选择器生成命令即可;TensorFlow 在 Linux/WSL2 下可通过 tensorflow[and-cuda] 自动安装相关 NVIDIA pip 依赖,而 Windows 原生 GPU 支持停留在 TensorFlow 2.10 时代。

| 使用场景 | 推荐策略 | 原因 |

| 只跑 PyTorch 项目 | 优先按 PyTorch 官网选择器安装 CUDA 版 PyTorch。 | 很多情况下无需单独安装完整 CUDA Toolkit,减少冲突。 |

| 需要编译 CUDA 扩展 | 安装与项目要求匹配的 CUDA Toolkit,并配置编译器。 | 自定义算子、xformers、flash-attn 等场景可能需要 nvcc。 |

| TensorFlow 新版 GPU | Linux 或 WSL2 + pip install tensorflow[and-cuda]。 | 官方文档已不推荐 Windows 原生新版 GPU 路线。 |

| 服务器推理服务 | 优先 Docker + NVIDIA Container Toolkit。 | 环境可复现,便于部署 vLLM、TGI、ComfyUI、Open WebUI。 |

| 老显卡/旧项目 | 查看 CUDA Toolkit Archive 和项目 requirements。 | 新版本 CUDA 可能不再覆盖旧架构或旧框架。 |

四、Windows:显卡驱动 + CUDA + cuDNN 安装流程

1. 安装或更新 NVIDIA 显卡驱动

Windows 新手建议优先使用 NVIDIA App 或 NVIDIA 官方驱动下载页。普通游戏用户可选择 Game Ready Driver;视频剪辑、建模、AI 创作和稳定性优先的用户更适合 Studio Driver。安装驱动后重启电脑,然后打开 PowerShell 或 CMD 执行:

nvidia-smi

如果能看到显卡型号、驱动版本、显存占用等信息,说明驱动层基本可用。

2. 下载 CUDA Toolkit

进入 NVIDIA CUDA Toolkit 下载页,依次选择 Windows、x86_64、系统版本和安装方式。新手建议选择本地安装包或官方推荐的网络安装方式。CUDA 13.1 之后 Windows 安装包不再捆绑显示驱动,因此驱动需要单独从 NVIDIA 官方站点安装或更新。

nvcc –version

如果提示找不到 nvcc,通常说明 Toolkit 没有安装,或 CUDA 的 bin 目录没有加入 PATH。

3. 安装 cuDNN

cuDNN 可以通过 NVIDIA 官方安装包、系统包、tar/zip 包或深度学习框架依赖间接获得。新手不建议手动复制大量 dll 文件到系统目录;更稳妥的做法是优先使用框架官方推荐命令。只有在项目明确要求本机 cuDNN 时,再按照 NVIDIA cuDNN 安装文档操作。

| Windows 重点:如果你只是跑 PyTorch,很多时候安装 CUDA 版 PyTorch 后即可使用 GPU,不需要手动安装 cuDNN。若使用 TensorFlow 新版 GPU,优先考虑 WSL2。 |

五、Linux 服务器:推荐安装顺序

Linux 服务器更适合 AI 训练、推理服务和长期运行任务。推荐顺序是:先确认系统和内核,再安装 NVIDIA 驱动,确认 nvidia-smi 正常,再安装 CUDA Toolkit 或容器工具包。

1. 更新系统并安装基础工具

# Ubuntu / Debian

sudo apt update

sudo apt install -y build-essential git curl wget python3 python3-venv python3-pip

# Rocky / CentOS / RHEL

sudo dnf update -y

sudo dnf groupinstall -y “Development Tools”

sudo dnf install -y git curl wget python3 python3-pip

2. 安装 NVIDIA 驱动并验证

驱动安装方式与发行版、显卡类型、是否使用云厂商镜像有关。Ubuntu 桌面可以使用“附加驱动”;服务器建议按 NVIDIA 官方 Linux 安装指南或发行版仓库进行。安装完成后执行:

nvidia-smi

3. 安装 CUDA Toolkit

如果项目需要 nvcc 或 CUDA 开发工具,再安装 CUDA Toolkit。Linux 官方指南支持 deb/rpm 包、runfile、网络仓库等方式。生产服务器更建议使用包管理器方式,便于升级和卸载。

# 验证 CUDA Toolkit

nvcc –version

# 查看 CUDA 安装目录

ls /usr/local | grep cuda

4. 配置环境变量

如果使用 /usr/local/cuda 作为默认链接,可在 ~/.bashrc 或 /etc/profile.d/cuda.sh 中添加:

export PATH=/usr/local/cuda/bin:$PATH

export LD_LIBRARY_PATH=/usr/local/cuda/lib64:$LD_LIBRARY_PATH

修改后执行 source ~/.bashrc 或重新登录终端。

六、WSL2:Windows 用户跑新版 TensorFlow / Linux AI 工具的推荐路线

WSL2 的核心思路是:Windows 侧安装 NVIDIA 驱动,Linux 子系统里安装 Python、AI 框架和项目依赖。不要在 WSL2 里再安装 Windows 驱动。安装完成后,在 WSL2 的 Ubuntu 终端中执行 nvidia-smi 验证 GPU 是否透传成功。

# Windows PowerShell 启用 WSL2 后安装 Ubuntu

wsl –install

# 在 Ubuntu 终端验证 GPU

nvidia-smi

| 适合场景:TensorFlow 新版 GPU、Linux 版 vLLM、许多只支持 Linux 的 AI 工具,Windows 用户都可以优先考虑 WSL2。 |

七、Docker:生产部署更推荐的方式

如果你要部署 AI 服务,而不是只在本机跑脚本,Docker 通常更稳定。Docker 方案的核心是安装 NVIDIA Container Toolkit,让容器可以访问宿主机 GPU。

# 验证 Docker 容器能否看到 GPU

sudo docker run –rm –gpus all nvidia/cuda:12.8.0-base-ubuntu24.04 nvidia-smi

如果容器中能输出 nvidia-smi,说明 Docker GPU 通路已经打通。之后部署 vLLM、ComfyUI、Open WebUI、LocalAI 等工具时,才有必要继续排查框架层问题。

八、安装 PyTorch 并验证 GPU

PyTorch 官方提供“Start Locally”安装选择器。选择系统、包管理器、语言和 CUDA 版本后,直接复制官网生成的命令。安装后验证:

python – <<‘PY’

import torch

print(‘torch version:’, torch.__version__)

print(‘cuda available:’, torch.cuda.is_available())

if torch.cuda.is_available():

print(‘gpu:’, torch.cuda.get_device_name(0))

print(‘torch cuda:’, torch.version.cuda)

PY

PyTorch 常见判断

- torch.cuda.is_available() 为 True:框架已识别 GPU。

- nvidia-smi 正常但 PyTorch 为 False:多半是装成了 CPU 版 PyTorch,或 Python 环境用错。

- torch.version.cuda 为空:通常说明当前 PyTorch 不是 CUDA 版。

- 显存不足不是安装失败:说明 GPU 通路已通,但模型太大或 batch 太大。

九、安装 TensorFlow 并验证 GPU

TensorFlow 的 GPU 路线要特别注意系统差异。官方文档说明,Windows 原生 GPU 支持停留在 TensorFlow 2.10;TensorFlow 2.11 及以后如果需要 GPU,建议使用 WSL2 或 Linux。Linux/WSL2 下可使用 tensorflow[and-cuda]。

python3 -m venv tf

source tf/bin/activate

pip install –upgrade pip

pip install tensorflow[and-cuda]

python3 -c “import tensorflow as tf; print(tf.config.list_physical_devices(‘GPU’))”

十、cuDNN 是否一定要手动安装?

不一定。过去很多教程会要求用户手动下载 cuDNN 压缩包,然后复制 include、lib、bin 到 CUDA 目录。现在更推荐优先遵循框架官方安装方式:PyTorch 的 CUDA 版 wheel/conda 包通常包含所需运行依赖;TensorFlow Linux/WSL2 文档也提供 tensorflow[and-cuda] 方案。只有在特定 C++ 项目、旧版本 TensorFlow、需要本机系统级 cuDNN 或编译环境时,才建议手动安装 cuDNN。

| 情况 | 是否建议手动装 cuDNN | 建议 |

| 普通 PyTorch 用户 | 通常不需要 | 按 PyTorch 官网命令安装 CUDA 版即可。 |

| TensorFlow Linux/WSL2 新版 | 通常不需要手动复制文件 | 使用 pip install tensorflow[and-cuda]。 |

| 旧版 TensorFlow / 课程指定版本 | 可能需要 | 按课程要求匹配 CUDA/cuDNN 版本。 |

| C++/自定义推理程序 | 可能需要 | 按 NVIDIA cuDNN 官方安装指南配置。 |

| Docker 容器 | 通常不在宿主机手动装 | 使用包含 CUDA/cuDNN 的基础镜像或项目镜像。 |

十一、安装完成后的验证命令速查

# 1. 驱动层

nvidia-smi

# 2. CUDA Toolkit

nvcc –version

# 3. PyTorch

python -c “import torch; print(torch.cuda.is_available()); print(torch.version.cuda)”

# 4. TensorFlow

python -c “import tensorflow as tf; print(tf.config.list_physical_devices(‘GPU’))”

# 5. Docker GPU

sudo docker run –rm –gpus all nvidia/cuda:12.8.0-base-ubuntu24.04 nvidia-smi

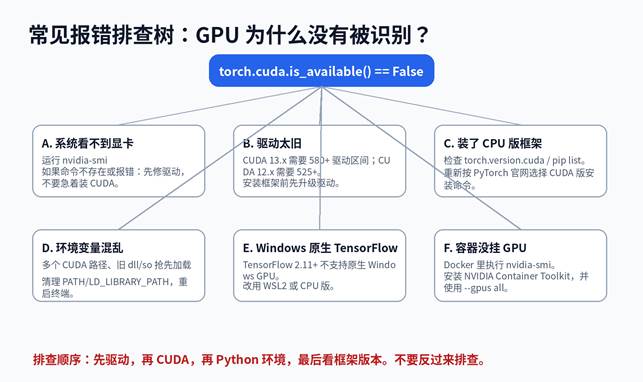

十二、常见问题排查:从驱动到框架逐层定位

| 问题表现 | 优先检查 | 解决方向 |

| nvidia-smi 不是内部命令 / command not found | 驱动是否安装、PATH 是否生效、是否在容器/WSL 中执行。 | 先重装或更新驱动,重启后再测。 |

| nvidia-smi 报 Driver/library version mismatch | 驱动升级后内核模块未刷新,或系统里有残留驱动。 | 重启;Linux 下检查 dkms、nouveau、驱动包冲突。 |

| nvcc –version 找不到 | 是否安装 CUDA Toolkit,而不是只装了驱动。 | 安装 Toolkit 或配置 PATH。 |

| PyTorch 检测不到 GPU | 当前 Python 环境里的 torch 是否为 CUDA 版。 | 卸载 CPU 版,按官网选择器重新安装。 |

| TensorFlow Windows 新版看不到 GPU | 是否使用 Windows 原生 TensorFlow 2.11+。 | 改用 WSL2 或安装旧版 TensorFlow 2.10 路线。 |

| Docker 容器内看不到 GPU | 宿主机 nvidia-smi 是否正常,Container Toolkit 是否安装。 | 安装 NVIDIA Container Toolkit,运行容器时加 –gpus all。 |

| 显存不足 CUDA out of memory | 模型大小、batch size、并发数、显存碎片。 | 换小模型、降低 batch、量化、关闭占用显存的进程。 |

十三、推荐安装路线:新手直接照抄

| 你的情况 | 推荐路线 |

| Windows + NVIDIA 显卡 + 跑 PyTorch | 装 NVIDIA 驱动 → Python/conda/venv → 按 PyTorch 官网选择 CUDA 版命令 → 验证 torch.cuda.is_available。 |

| Windows + TensorFlow GPU | 装 NVIDIA 驱动 → 安装 WSL2 Ubuntu → 在 WSL2 中装 Python → pip install tensorflow[and-cuda]。 |

| Linux 服务器训练/推理 | 装驱动 → nvidia-smi → Docker + NVIDIA Container Toolkit → 用容器部署 AI 工具。 |

| 需要编译 CUDA 扩展 | 装驱动 → 装匹配版本 CUDA Toolkit → 配置编译器 → 创建 Python 环境 → 安装项目依赖。 |

| 只是本地大模型推理 | 优先 Ollama/LM Studio;需要 GPU 服务再考虑 CUDA/Docker/vLLM。 |

十四、FAQ:新手最容易问的 10 个问题

1. nvidia-smi 里有 CUDA Version,是不是 CUDA 已经装好了?

不是。它表示驱动可兼容的 CUDA 能力上限。是否安装 CUDA Toolkit 要看 nvcc –version。

2. 必须先装 CUDA 再装显卡驱动吗?

不建议。一般先装驱动,确认 nvidia-smi 正常,再考虑 CUDA Toolkit。

3. PyTorch 能用 GPU,是否还需要 cuDNN?

普通用户通常不用手动安装。PyTorch CUDA 版包一般已包含所需运行依赖。

4. TensorFlow 为什么在 Windows 上找不到 GPU?

TensorFlow 2.11+ 不再支持原生 Windows GPU,建议走 WSL2。

5. CUDA 版本是不是越新越好?

不是。应该优先匹配项目和框架支持版本。

6. 安装多个 CUDA 版本可以吗?

可以,但要清楚 PATH、CUDA_HOME、LD_LIBRARY_PATH 指向哪个版本,否则容易冲突。

7. 笔记本双显卡会影响吗?

可能。需要确保 NVIDIA 驱动正常,部分软件需要在显卡控制面板中指定高性能 GPU。

8. AMD 显卡能装 CUDA 吗?

不能。CUDA 是 NVIDIA 平台;AMD 可关注 ROCm。

9. 服务器推荐裸机装 CUDA 还是 Docker?

长期部署更推荐 Docker + NVIDIA Container Toolkit,裸机适合开发或必须编译的场景。

10. 最稳的排查顺序是什么?

驱动层 nvidia-smi → CUDA Toolkit nvcc → Python 环境 → 框架版本 → 项目代码。

官方参考来源

- NVIDIA CUDA Toolkit Downloads:https://developer.nvidia.com/cuda-downloads

- NVIDIA CUDA Installation Guide for Microsoft Windows:https://docs.nvidia.com/cuda/cuda-installation-guide-microsoft-windows/

- NVIDIA CUDA Installation Guide for Linux:https://docs.nvidia.com/cuda/cuda-installation-guide-linux/

- NVIDIA CUDA Toolkit Release Notes:https://docs.nvidia.com/cuda/cuda-toolkit-release-notes/index.html

- NVIDIA cuDNN Downloads:https://developer.nvidia.com/cudnn-downloads

- NVIDIA cuDNN Installation Guide:https://docs.nvidia.com/deeplearning/cudnn/installation/latest/index.html

- NVIDIA App / Driver Updates:https://www.nvidia.com/en-eu/software/nvidia-app/

- PyTorch Get Started Locally:https://pytorch.org/get-started/locally/

- TensorFlow Install with pip:https://www.tensorflow.org/install/pip