AI安全与治理为什么成为新焦点

从“模型可用”走向“系统可控”,企业、平台与监管都在重写 AI 运行规则

| 导读:当 AI 还是一个聊天工具时,人们最担心的是它“答错”。但当 AI 升级为会调用工具、连接企业数据、跨系统执行任务的智能体后,真正的核心问题开始转向权限、隐私、可追责、越权操作、审计留痕与事故处置。AI 安全与治理之所以成为新焦点,不是因为行业忽然重视伦理,而是因为 AI 已经进入真实业务流程,风险开始具有经营后果与合规后果。 |

过去两年,AI 讨论的重心正发生变化。早期的重点是模型能力、参数规模、推理效果和多模态体验;如今,越来越多组织开始追问另外一组问题:哪些场景可以上线?谁对输出负责?日志怎么留?异常怎么停机?模型接入了哪些外部系统?员工能否直接把客户资料、代码仓库和内部文档交给智能体处理?

这些问题共同指向一个事实:AI 已经不再只是“会说话的软件”,而是在逐步变成真正的业务执行层。当 AI 的能力从生成答案扩展到做决策、发请求、改数据、调用 API、触发流程时,安全与治理就不再是附属选项,而会变成 AI 大规模应用的基础设施。

一、为什么现在才真正进入“安全与治理时刻”

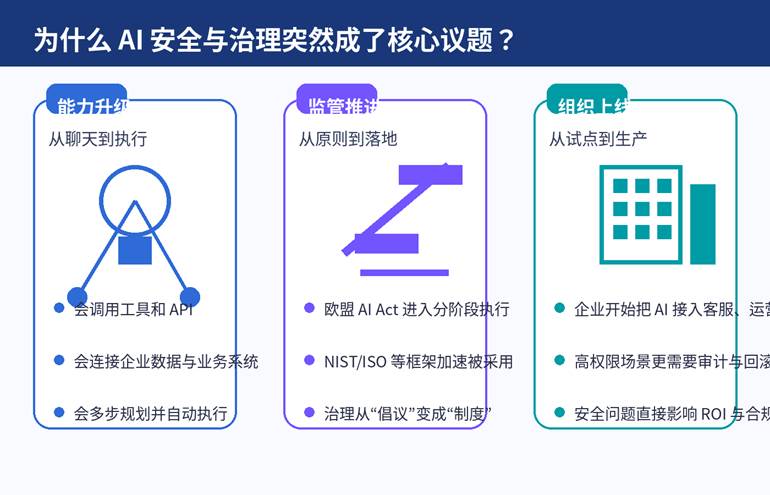

1. 从“聊天风险”转向“执行风险”

传统聊天式 AI 的主要风险集中在幻觉、偏见、不当内容和事实错误。但执行式 AI 会把风险面扩大到现实系统:它可能读取企业知识库、访问客户数据、调用 SaaS 工具、发起自动化流程,甚至在开发、客服、营销、采购和运维场景中直接采取动作。

这意味着风险不再只是“说错一句话”,而可能变成“做错一件事”。例如,错误的数据调用会带来隐私泄露,越权工具调用会带来安全问题,错误自动化会带来业务损失,缺乏留痕会让企业无法追溯责任。

2. 监管已从框架讨论进入执行阶段

监管环境的变化也在推动安全与治理快速升温。欧盟 AI Act 已经进入分阶段实施:通用条款与禁止性规定自 2025 年 2 月 2 日起适用,通用 AI 模型相关规则自 2025 年 8 月 2 日起适用,而多数核心规则和执法则从 2026 年 8 月 2 日开始进入落地阶段。

对组织而言,这意味着 AI 治理不再只是“先等等看”的议题,而是需要在模型选型、数据流程、审计机制、供应商管理和员工使用规范上尽快建立制度化能力。

3. 行业风险证据正在持续积累

安全与治理成为焦点,还有一个更直接的原因:风险案例在上升。Stanford HAI 发布的 2025 AI Index 显示,AI Incidents Database 记录的 AI 相关事故在 2024 年达到 233 起,较 2023 年增长 56.4%。

事故和失误不会自动等于全面失控,但它们足以说明:当 AI 被更广泛地部署到搜索、客服、内容生成、风控、招聘、代码、推荐和社交媒体等场景时,组织必须把“如何持续控制风险”当作常规经营能力来建设。

二、AI 安全与治理,究竟在治理什么

1. 治理的对象不是单个模型,而是整个 AI 系统

很多企业一谈治理,就会先想到给大模型加一层内容审核。事实上,这远远不够。真正需要治理的是“模型 + 数据 + 提示词/工作流 + 工具调用 + 权限体系 + 人机协同 + 日志监控 + 供应商关系”所构成的完整系统。

同一个模型,在不同数据、不同权限、不同流程约束下,风险等级可能完全不同。一个只用于草拟内部会议纪要的助手,与一个能改 CRM 数据、能发邮件、能调用付款流程的智能体,治理要求绝不可能相同。

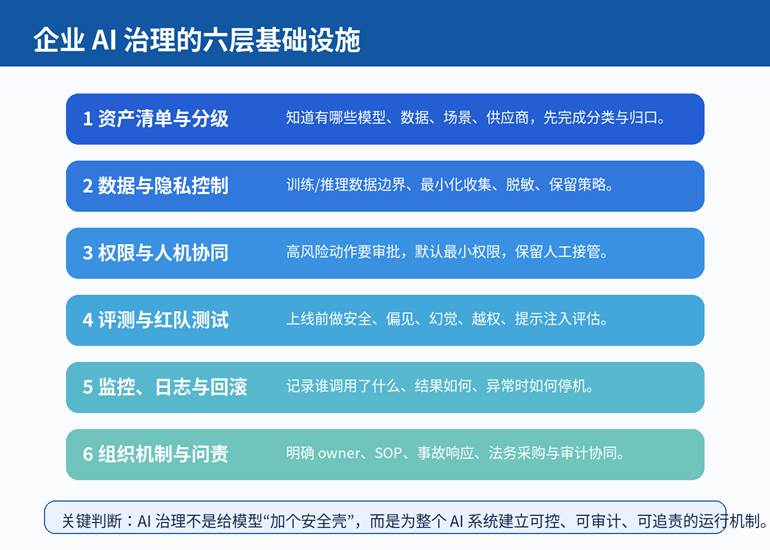

2. 核心治理对象主要有六类

第一是资产清单与分级。组织要先知道自己到底部署了哪些模型、调用了哪些供应商、覆盖了哪些业务流程、访问了哪些数据类型。

第二是数据与隐私。包括训练数据来源是否合法、推理数据是否最小化、是否脱敏、是否留存、能否跨境、是否进入第三方模型再训练。

第三是权限与审批。高风险动作必须设置明确的人机边界,默认最小权限,并保留人工接管和审批机制。

第四是评测与红队测试。上线前要验证越权、幻觉、提示注入、越狱、偏见、不当输出和工具误调用等问题。

第五是监控与回滚。要能记录调用链、关键输入输出、版本号、工具动作和异常事件,并在必要时快速下线或切换方案。

第六是组织问责。必须明确 owner、法务接口、采购要求、事故响应路径、员工培训与例外审批机制。

三、为什么企业和平台都开始把治理放到前面

1. 因为没有治理,AI 很难真正上生产环境

企业最在意的不是 Demo 是否惊艳,而是系统能否稳定、合规、可审计、可复制。没有治理,AI 只能停留在个人提效和小范围试点;一旦进入客户数据、财务流程、代码库、工单系统和供应链场景,就必须回答安全与责任问题。

因此,很多组织现在不是“先全面上 AI,再补治理”,而是反过来:先确定哪些场景允许接入,哪些数据不可外发,哪些动作必须审批,哪些日志必须保存,然后才谈规模部署。

2. 因为智能体让“权限问题”变得前所未有地关键

随着智能体兴起,治理的重心明显前移。Anthropic 在 2025 年发布的可信智能体框架中,把“让人类保持控制”“确保交互安全”“保持透明”“保护隐私”都列为核心原则。原因很简单:智能体不是只负责输出文本,而是在自驱循环中规划、行动、观察和调整。

一旦 AI 能自我规划并多步执行,权限管理就成为底线能力。谁能读取哪些系统?能不能写入?是否需要二次确认?遇到高风险动作是否强制人工批准?这些都是治理设计的核心。

3. 因为行业开始出现可操作的治理框架

过去很多企业之所以对 AI 治理迟迟不动手,是因为不知道该从哪里开始。如今,可参考的框架明显多了。NIST 的 AI RMF 本身就是面向组织落地的风险管理框架,2024 年又发布了生成式 AI Profile;到 2026 年,NIST 还发布了面向关键基础设施的 AI RMF Profile 概念说明,显示治理正在走向更行业化的实践。

同时,ISO/IEC 42001 作为 AI 管理体系标准,也提供了更偏组织治理的制度框架。它的重要意义不在于‘买一张证书’,而在于提醒企业把 AI 看成一个需要长期运行、持续改进和跨部门协作的管理对象。

四、接下来最值得关注的治理变化

1. 从“模型治理”转向“系统治理”

未来治理的重点不会只放在模型本身的对齐和过滤,而会更多转向系统层面:数据入口是否可信、工具调用是否受限、上下文是否被污染、输出是否进入关键业务流程、异常能否被人及时发现并中止。

也就是说,安全与治理将越来越像云安全、数据治理和内部控制的结合体,而不是一套孤立的“AI 伦理清单”。

2. 从一次性评估转向持续运行

AI 风险不是上线前测一次就结束。模型会更新,提示词会变化,插件会新增,供应商策略会调整,用户也会不断探索系统边界。因此,真正有效的治理必须包含持续监控、定期复评、版本变更管理和事故复盘。

这也是为什么越来越多企业开始把治理团队、平台团队、法务、采购、审计和业务 owner 拉到同一条流程上:AI 已经变成跨部门运行的问题。

3. 从“是否使用 AI”转向“如何可信使用 AI”

过去企业讨论的是要不要上 AI;现在更现实的问题是:如何在可控边界内持续放大 AI 的价值。未来真正拉开差距的,不只是模型能力本身,而是谁能建立起更成熟的治理底座,让 AI 在更多场景里安全上线、稳定运行、持续迭代。

换句话说,AI 安全与治理之所以成为新焦点,不是因为行业转向保守,而是因为 AI 已经足够重要,不能再靠临时规则和个人经验来管理。

五、企业落地建议:先做这五件事

第一,建立 AI 资产清单。把模型、供应商、部门使用场景、接入系统、数据类型先盘点清楚。

第二,按风险做分级。至少区分低风险内容辅助、中风险流程辅助和高风险自动执行三类场景。

第三,补齐权限与审批链。默认最小权限,高风险动作强制人工确认。

第四,设置日志、监控和停机机制。保证关键动作可追溯、可告警、可回滚。

第五,把治理写成制度。包括采购条款、员工规范、供应商评估、事故上报和复盘流程。

结语

AI 安全与治理成为新焦点,本质上反映的是 AI 的角色变化:它正在从会回答问题的工具,变成会参与流程、调用系统、影响结果的执行层。能力越强、接入越深、权限越大,越需要治理。

接下来的竞争,不只是“谁的模型更聪明”,更是“谁能把更聪明的模型放进一个可控、可信、可追责的系统里”。这,才是未来 AI 规模化落地的真正门槛。

图解一:AI 安全与治理升温的三大驱动

图 1 AI 安全与治理从“附属议题”走向“核心基础设施”的三大推动力

图解二:企业 AI 治理的六层基础设施

图 2 治理对象不是单个模型,而是覆盖数据、权限、评测、监控与问责的完整系统

FAQ:关于 AI 安全与治理的常见问题

1. AI 安全和 AI 治理是一回事吗?

不完全相同。AI 安全更偏向风险预防与技术控制,例如越权、防攻击、提示注入、防误用;AI 治理则更偏组织机制,包括政策、流程、权限、问责、审计和合规。两者通常需要同时建设。

2. 只有大公司才需要 AI 治理吗?

不是。中小团队同样需要治理,只是复杂度不同。哪怕只有一个客服机器人,只要它接触到客户数据、品牌声誉或真实交易,就需要最基本的边界、审批和日志。

3. 买了成熟大模型,是不是就可以少做治理?

不能。供应商安全能力很重要,但组织仍需对自身数据、权限、流程和使用方式负责。很多风险并不来自底层模型,而来自接入方式和业务设计。

4. 治理会不会拖慢 AI 落地?

短期会增加流程设计成本,但长期会显著提升上线效率。因为没有治理的试点很难复制,也很难通过法务、IT、安全和采购审查。

5. 哪些场景最应该优先做治理?

优先级通常取决于三个因素:是否接触敏感数据、是否能触发真实动作、是否会直接影响客户或财务结果。满足两项以上的场景,应优先纳入治理范围。

6. 2026 年最值得关注的治理趋势是什么?

一是智能体权限治理,二是面向行业的细化框架,三是把监控、评测、回滚和事故响应纳入持续运营,而不再停留在上线前合规审查。

相关阅读

- 《AI为什么正在从“聊天”走向“执行”》

- 《企业为什么开始大规模部署AI智能体》

- 《世界模型是什么?为什么被视为下一代AI方向》

- 《具身智能落地加速:AI正从屏幕走向真实世界》

- 《多模态AI升级后,内容创作会发生什么变化》

- 《2026年AI最新动态:智能体、世界模型、具身智能全面爆发》

参考资料

- Stanford HAI,《The 2025 AI Index Report》与 Responsible AI 章节,2025。

- NIST,《AI Risk Management Framework》与《Generative Artificial Intelligence Profile》,2023–2026。

- European Commission AI Act Service Desk,《Timeline for the Implementation of the EU AI Act》,2026。

- ISO,《ISO/IEC 42001:2023 Information technology — Artificial intelligence — Management system》。

- Anthropic,《Our framework for developing safe and trustworthy agents》,2025;《Trustworthy agents in practice》,2026。

- Google DeepMind,《Frontier Safety Framework 3.0》,2025。

- OpenAI,《Introducing OpenAI Frontier》,2026。