网站发布版 · 长文解读

AI为什么正在从“聊天”走向“执行”

副标题:2026 趋势观察——Agent、工具调用、MCP、世界模型与具身智能,正在把 AI 从“会说”推向“会做”

| 内容定位 趋势解读 / 行业观察 | 适合读者 AI 从业者 / 产品经理 / 运营 / 企业决策者 | 发布建议 专题文章 / 首页推荐 / 公众号同步 |

| 导语 • 过去两年,AI 的主流形态正在发生结构性变化:它不再满足于只在对话框里给答案,而是越来越多地进入工具、流程与真实业务系统。 • 当模型具备规划能力、工具调用能力、状态管理能力和权限边界之后,AI 的价值重心就从“聊天体验”转向“任务完成率”。 • 这也是为什么 2026 年最值得关注的不只是更大的模型,而是更能执行、更能协作、更能落地的 agentic AI。 |

一、什么叫“从聊天走向执行”?

所谓“聊天式 AI”,核心能力是理解问题、生成文本、给出建议。它的价值主要体现在问答、写作、翻译、总结、头脑风暴等场景。这样的 AI 很强,但它本质上仍然停留在“语言输出”层。

而“执行式 AI”则不同。它不是把回答停在对话框里,而是把“完成目标”作为第一优先级:它会先理解任务,再调用搜索、文件、数据库、浏览器、代码执行、业务 API 乃至桌面环境,最后把结果交付出来。这里的关键变化,不是模型会不会说,而是模型能不能把事情做完。

OpenAI 在 2025 年把 Responses API、web search、file search、computer use 与 Agents SDK 放在同一套 agent 叙事下;Anthropic 则围绕 MCP、computer use、agent loop、context engineering 持续推进;这些变化共同说明,行业重心正在从“更像人聊天”转向“更像一个可以协同工作的执行体”。[1][2][3][4][5]

聊天式 AI 与执行式 AI 的区别

| 维度 | 聊天式 AI | 执行式 AI | 业务价值 | 主要挑战 |

| 目标 | 回答问题 | 完成任务 | 从信息提供升级为结果交付 | 如何定义成功标准 |

| 输出 | 文本/图片/建议 | 报告、操作结果、已执行步骤、可验证产物 | 更接近真实 ROI | 如何校验真伪 |

| 能力 | 理解与生成 | 规划、调用工具、迭代修正、交付 | 能处理多步流程 | 多环节错误会累积 |

| 连接 | 对外部世界连接弱 | 可连搜索、文件、系统、桌面、机器人 | 进入业务现场 | 权限与安全复杂 |

| 评价 | 看回答是否像样 | 看任务是否完成、成本是否可控 | 容易进入生产流程 | 需要 tracing 与 eval |

图 1:从“聊天”到“执行”的五级跃迁

二、为什么这一变化会在 2025—2026 年集中爆发?

1. 模型不只会生成内容,还开始稳定地调用工具

过去,很多所谓“AI 自动化”其实依赖硬编码流程:模型只负责写文案,真正执行动作的是外部脚本。现在情况变了。围绕 agent 的 API 正在把“推理 + 工具调用 + 多轮状态”合并到同一套执行回路中。OpenAI 官方文档把 Responses API 定义为面向新项目的统一接口,并强调其 built-in tools、stateful context 与 agentic loop;这意味着“调用工具”已经不是外挂,而是产品设计的一部分。[1][2]

2. 外部系统连接正在标准化,MCP 成为重要接口层

让 AI 真正执行任务,最大的现实障碍从来不是“会不会写一段漂亮回答”,而是“能不能安全、稳定地连接外部系统”。MCP 的价值就在这里:它试图把原本碎片化的连接方式,抽象为统一协议。对企业来说,这意味着知识库、云盘、代码库、数据库、浏览器自动化工具不再每一个都要单独对接;对 agent 来说,这意味着可调用世界的边界被显著扩大。[3]

3. 状态、记忆、Tracing、Eval 开始成为第一性工程问题

一个只能单轮回答的模型,很难承担真正的工作流。执行式 AI 需要知道自己已经做到了哪一步、当前约束是什么、上一轮工具结果是否可靠、什么时候该请求人工确认。OpenAI 的开发者资料明确把 state、handoff、guardrails、tracing 放到 agent 生产实践中;Anthropic 也反复强调 agent harness、context engineering 与长任务上下文管理。行业已从“写提示词”转向“做系统工程”。[5][6][7]

| 为什么“执行式 AI”更有商业价值 • 它能把自然语言直接转化为跨系统操作,减少人工切换软件的成本。 • 它能处理长流程任务,把搜索、整理、判断、生成、校验串成一个闭环。 • 它更容易被企业衡量:完成率、时长、错误率、人工接管率,都能成为量化指标。 |

三、世界模型:为什么它会成为“执行”的隐形底座?

很多人一提世界模型,就想到“能生成视频的 AI”。但在更深一层,世界模型的真正意义并不是更像电影,而是更像“可交互、可预测、可仿真的环境”。当 AI 能在一个连续、可操作的环境里预测“动作会导致什么结果”,它就更适合承担长期任务,而不仅仅是生成一段静态答案。

Google DeepMind 在 2025 年发布 Genie 3,将 world model 描述为可以根据文本生成并实时导航的动态世界;NVIDIA Cosmos 则把 world foundation models 明确指向 physical AI 的世界生成、理解与仿真;World Labs 也在推进可探索 3D world 的 API 能力。这说明“世界模型”已经从论文概念,逐步变成 agent 和机器人训练、测试、仿真的基础设施。[8][9][10]

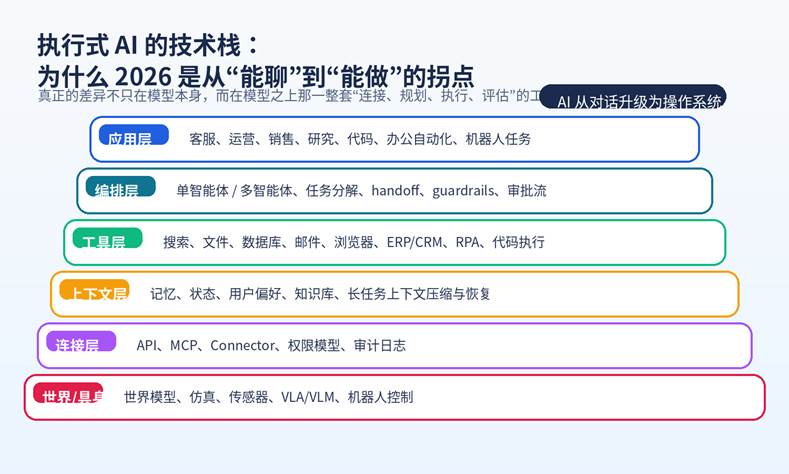

图 2:执行式 AI 的技术栈——真正的差异在模型之上的工程系统

四、具身智能:当“执行”进入物理世界,AI 的边界被再次改写

如果说浏览器操作、文件处理和企业系统联动,代表 AI 在数字世界中学会“执行”;那么具身智能,则代表 AI 正在走进物理世界。Google DeepMind 的 Gemini Robotics 直接把“感知、推理、使用工具、与人交互、在现实世界行动”写入模型能力描述;Figure 的 Helix 02 进一步把全身控制、长时程任务和全传感器输入整合到一个统一系统里。[11][12]

这一步的意义非常大。因为现实世界的任务并不像对话那样只有一条文本输入,而是包含空间、物体、阻力、触觉、误差、失败恢复和安全边界。具身智能一旦成熟,AI 就不再只是软件助手,而是可能成为真正的“操作代理”。物流分拣、仓储搬运、设备巡检、家庭辅助,这些场景都会在未来几年快速升温。

五、2026 年最值得关注的五类落地场景

| 场景 | 为什么现在可行 | 典型任务 | 落地提醒 |

| 企业知识工作 | 搜索、文件、长上下文与评估工具更成熟 | 调研、竞品分析、报告初稿、会议纪要 | 先从半自动交付开始 |

| 办公自动化 | 邮件、日历、表单、CRM 等系统容易接入 | 整理询盘、录入信息、提醒与跟进 | 必须设审批节点 |

| 客服与运营 | 单智能体 + 工具足以承担大量标准任务 | 知识检索、工单分流、回复建议 | 要监控错误率与越权 |

| 代码与研发协作 | 代码执行、检索与 agent harness 已较成熟 | 读仓库、改代码、补测试、生成文档 | 需要沙箱与回滚 |

| 机器人/physical AI | 世界模型与 VLA/VLM 推动训练和部署 | 抓取、搬运、巡检、环境交互 | 安全与成本仍是核心门槛 |

六、对个人与企业分别意味着什么?

对个人:提示词能力仍重要,但不再是全部

未来真正拉开差距的,不只是“会不会提问”,而是“会不会把任务拆成可执行流程”。一个高水平的个体 AI 使用者,往往具备四种能力:明确目标、定义约束、选择工具、验证结果。也就是说,AI 使用者正在从“会聊天的人”进化为“会编排任务的人”。

对企业:不要先追求全自动,而要先做可控的半自动

企业导入执行式 AI,最容易犯的错误是一步到位追求“全自动无人值守”。实际上,更稳健的路径通常是:先选一个高频、边界清晰、结果可验收的流程,用单智能体 + 少量工具完成;再加入审批流、日志、监控、复盘;最后才考虑多智能体协作与更大权限。OpenAI 和 Anthropic 的官方实践都强调“从简单可组合模式开始”,这一点非常值得企业借鉴。[5][6]

七、执行式 AI 不是万能药,它仍有清晰边界

- 第一,模型会犯错,而且多步任务中的错误会连锁放大。

- 第二,权限一旦过大,风险会远高于普通聊天产品,尤其在浏览器、桌面和企业系统场景中。

- 第三,长任务并不等于稳定任务;上下文污染、目标漂移、工具误选依然常见。

- 第四,很多行业真正的难点不是模型本身,而是系统接入、组织协作、审计合规和责任界定。

- 第五,物理世界的执行比数字世界复杂得多,机器人领域仍受制于成本、安全和通用性。

| 写给站长 / 内容创作者的一句判断 • 未来热门内容将不再只是“某某模型厉害在哪”,而会越来越聚焦“这个 AI 能帮我把什么事做完”。 • 围绕 agent、MCP、computer use、world model、具身智能展开的解释型内容、案例型内容和工作流型内容,都会具备更强的持续流量价值。 |

结语:AI 的下一个竞争,不是谁更会说,而是谁更会做

从聊天到执行,并不是 AI 抛弃对话,而是对话正在退回到入口层。真正决定价值的,将是 AI 能否把语言理解、工具使用、状态管理、环境感知与结果校验连接起来,形成可重复、可审计、可扩展的任务闭环。

因此,2026 年最值得关注的,不只是更长的上下文、更炫的 demo 或更流畅的人设,而是那些能够把“理解世界”进一步转化为“操作世界”的系统。无论是在浏览器里、企业软件里,还是在机器人所面对的真实环境中,AI 都正在从“陪你聊天”走向“替你执行”。

FAQ

1. “执行式 AI”是不是就是智能体(Agent)?

可以把它理解为更广义的 agentic AI。Agent 是其中最典型的形态,但凡是能围绕目标进行规划、调用工具、管理状态并交付结果的系统,都属于“从聊天走向执行”的范畴。

2. MCP 为什么这么重要?

因为 AI 真正落地时,最大的难点不是生成一句话,而是连接真实系统。MCP 让数据源、工具和 AI 应用之间更容易建立统一连接,从而降低集成成本。

3. 世界模型和视频生成是一回事吗?

不完全是。视频生成更强调画面输出;世界模型更强调环境动态、动作反馈和可交互性。后者更适合做仿真、预测和 agent 训练。

4. 具身智能离普通人还有多远?

短期内更可能先在物流、仓储、巡检等相对可控场景普及,进入家庭和开放环境则需要更强的安全性、通用性与成本优化。

5. 企业应该先做多智能体吗?

不建议。多数企业更适合从“单智能体 + 少量工具 + 明确审批”开始,把流程跑通后再考虑 handoff 和多角色协作。

6. 普通内容创作者要不要关注这些趋势?

要。因为用户搜索意图已经从“AI 能做什么”转向“AI 怎么帮我把这件事做完”。这会直接改变文章选题、SEO 结构和转化逻辑。

7. 执行式 AI 会替代聊天式 AI 吗?

不会。聊天仍然是最自然的入口,但它会越来越多地承担“指令输入、澄清约束、结果解释”的角色,而执行发生在对话背后的系统里。

参考资料

[1] OpenAI, New tools for building agents, 2025.

[2] OpenAI API Docs, Migrate to the Responses API, 2025–2026.

[3] Anthropic, Introducing the Model Context Protocol, 2024.

[4] Anthropic Docs, Computer use tool, 2025–2026.

[5] OpenAI, A practical guide to building agents, 2025.

[6] OpenAI for Developers in 2025, OpenAI Developers Blog, 2025.

[7] Anthropic, Building effective agents / Effective context engineering for AI agents, 2024–2025.

[8] Google DeepMind, Genie 3: A new frontier for world models, 2025.

[9] NVIDIA, Cosmos: Physical AI with World Foundation Models, 2025–2026.

[10] World Labs, World API / Marble world model, 2025–2026.

[11] Google DeepMind, Gemini Robotics, 2025–2026.

[12] Figure, Helix 02: Full-Body Autonomy, 2026.

[13] Stanford HAI, The 2025 AI Index Report, 2025.