世界模型是什么?为什么被视为下一代 AI 方向

关键词:世界模型 / 空间智能 / 具身智能 / 物理 AI / 合成数据 / 交互式环境

定位:趋势解读 · 科普向长文 · 可直接用于网站发布

| 导读摘要 过去两年,行业讨论 AI 的焦点,正在从“它能不能把话说对”转向“它能不能理解环境、预判变化并完成执行”。世界模型正是这一转向的关键概念:它不只处理文本或画面,而是试图对环境状态、动作结果和时空变化规律建立可计算的内部表征。Google DeepMind 将世界模型定义为一种能够模拟环境动态、预测环境如何演化以及动作会产生什么影响的系统。[1] 也正因此,世界模型被广泛视为连接感知、推理、规划和行动的下一代 AI 路径。 |

先看结论

• 世界模型的核心,不是“能生成一段视频”,而是“能根据状态与动作,推演世界接下来会怎样”。

• 它比聊天式大模型更接近行动,比传统视频模型更接近环境模拟,比单纯机器人控制更强调抽象世界理解。

• 在机器人、自动驾驶、游戏仿真、工业数字环境和合成数据生成等方向,世界模型的价值已经非常具体。

• 但世界模型还远未成熟:长时一致性、物理真实性、可评估性、成本与安全约束,仍是主要难点。[11]

一、世界模型到底是什么?

通俗一点说,世界模型就是让 AI 不只“看见输入”,而且能在内部形成一个关于外部环境如何运转的简化模型。这个模型要回答三个问题:当前世界处在什么状态?如果发生某个动作,接下来会怎样变化?在不同选择之间,哪条路径更可能导向目标?

Google DeepMind 在 Project Genie 的官方解释中,把世界模型描述为:能够模拟环境动态,并预测这些环境如何演化、动作将带来什么结果的系统。[1] 这个定义很重要,因为它把世界模型和传统语言模型区分开了。语言模型擅长预测下一个 token;世界模型则更强调预测状态转移、空间关系和时间演化。

因此,世界模型不是某一种单一网络结构,也不等于某一家公司单独发布的某个产品。它更像一类能力集合:环境表征、动作条件生成、反事实推演、规划支持、长期一致性维护,甚至还可能包含物理规律近似与空间理解。

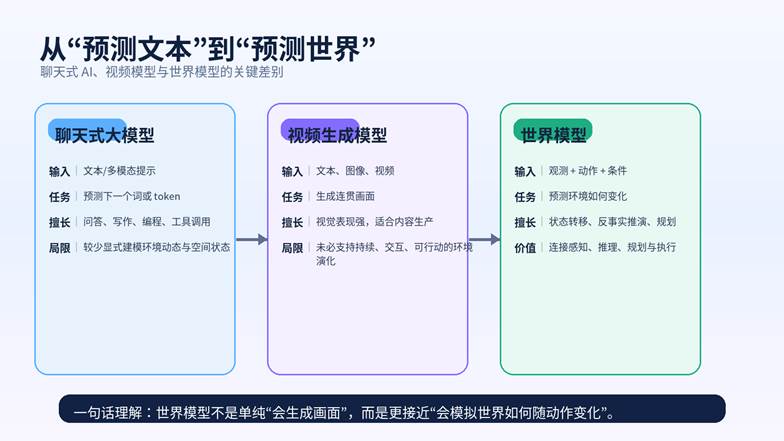

图 1 从“预测文本”到“预测世界”:聊天式 AI、视频模型与世界模型的区别

关键区别对照

| 维度 | 聊天式大模型 | 视频生成模型 | 世界模型 |

| 主要目标 | 生成合理回复与文本结构 | 生成连贯视觉内容 | 模拟环境与动作结果 |

| 输入形式 | 文本 / 多模态提示 | 文本、图像、视频 | 观测、状态、动作、条件 |

| 核心优势 | 知识调用、推理表达、工具使用 | 画面质量、创意表达 | 状态转移、规划、反事实推演 |

| 典型场景 | 问答、写作、客服、编程 | 短片、广告、镜头生成 | 机器人、自动驾驶、仿真、交互式世界 |

| 最大挑战 | 稳定推理与事实性 | 时空一致性与控制力 | 长时一致性、物理真实性、可评估性 |

二、为什么世界模型突然这么热?

原因并不神秘:因为 AI 正在从“聊天”走向“执行”。当系统开始接管浏览器、调用工具、操作机器人或在 3D 环境里完成任务时,单纯的语言能力已经不够了。它必须知道“环境当前是什么样”“动作会造成什么后果”“下一步如何调整”。

这也是为什么 2024 到 2026 年间,世界模型相关表述明显增多。Google DeepMind 先后发布 Genie 2 与 Genie 3,并明确将其描述为能够生成可交互环境、模拟动作后果的世界模型;其中 Genie 3 被定义为“通用世界模型”,能够生成前所未有多样性的交互式环境。[2][3] 这说明世界模型已经不只是论文概念,而正在被包装成可体验、可演示、可产品化的能力。

另一方面,机器人与物理 AI 的发展也在倒逼世界模型加速成熟。Google DeepMind 在 Gemini Robotics 的介绍中强调,机器人要在现实世界中有用,不仅需要多模态理解,还需要具身推理、空间理解、规划和控制协同工作;Gemini Robotics-ER 甚至把感知、状态估计、空间理解、规划和代码生成串到了一起。[12][13]

换句话说,世界模型之所以火,不是因为它是一个“更新的名词”,而是因为它正好踩在当前 AI 演进的主航道上:让系统从会说,走向会做。

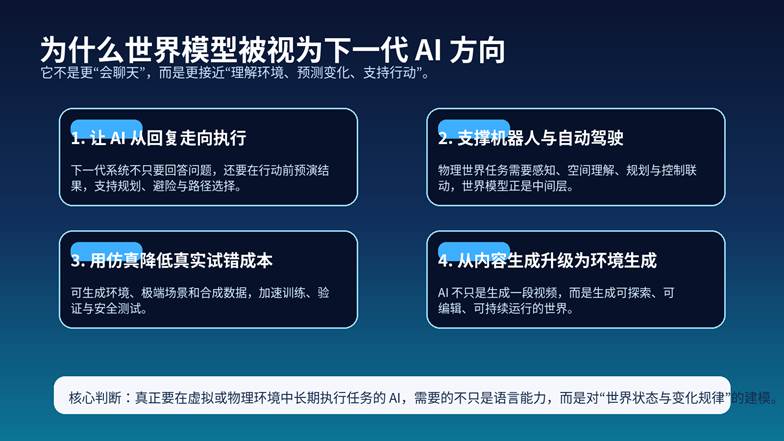

三、为什么它会被视为“下一代 AI”方向?

1. 它把 AI 从“回答问题”推进到“预演结果”:下一代 AI 的关键,不是生成更漂亮的一段文本,而是在行动前完成内部模拟。只有先预演,系统才可能做规划、避风险、选路径。

2. 它天然连接具身智能:机器人、自驾系统和 AR/VR 代理都必须在时空环境中工作。世界模型提供的是“环境如何变化”的中间层,而这正是具身智能所需要的。

3. 它能大幅放大仿真与合成数据价值:真实世界采集成本高、风险高、覆盖场景有限。NVIDIA 多次强调,世界基础模型能够生成物理环境视频、合成数据和可控环境,从而降低物理 AI 的训练与测试成本。[6][7][8]

4. 它让“内容生成”升级为“环境生成”:一段视频只是一种结果;一个可探索、可编辑、可交互、可持续存在的世界,则是更高一级的计算对象。World Labs 就把这条路线概括为空间智能与持久 3D 世界。[9][10]

图 2 世界模型为何被视为下一代 AI 路径:从回复式 AI 迈向环境理解与行动式 AI

四、2024—2026 年有哪些代表性进展?

下面这张表,适合直接把行业现状看清楚。

| 机构/方向 | 代表进展 | 核心指向 | 意义 |

| Google DeepMind | Genie 2 / Genie 3 / Project Genie | 可交互环境生成、动作条件模拟 | 把世界模型从研究演示推进到更接近产品体验。[1][2][3] |

| Meta AI | I-JEPA / V-JEPA / V-JEPA 2 | 视频表征学习、理解、预测与规划 | 强调在抽象表征层面学习世界规律,而非仅做像素级生成。[5] |

| NVIDIA | Cosmos 世界基础模型平台 | 物理 AI、合成数据、仿真验证 | 让世界模型直接服务机器人和自动驾驶开发流程。[6][7][8] |

| World Labs | Marble、World API、Spatial Intelligence | 持久 3D 世界、空间智能 | 推动从二维内容生成迈向可探索、可编辑、可共享的三维世界。[9][10] |

| 具身智能产业 | Gemini Robotics / Robotics-ER | 空间理解、规划、执行闭环 | 说明世界模型价值最终会体现在物理执行系统中。[12][13] |

五、它会落地到哪些场景?

机器人与自动驾驶:这是最直接的落地方向。系统需要在连续环境中判断位置、预测障碍、预演轨迹、调整抓取或行驶策略。

游戏、影视与交互式内容:传统视频模型给出的是成片;世界模型给出的则可能是可以探索、改写和持续运行的世界。

工业仿真与数字环境:在工厂、仓储、物流、城市交通等领域,世界模型可作为策略试验场,帮助先仿真再部署。

教育与训练:AI 可以生成带反馈的任务环境,而不只是提供一段答案,让学习从静态知识获取变成动态演练。

合成数据生产:对于极端天气、长尾异常、危险工况等真实采集代价高的场景,世界模型能成为更高效的数据工厂。[7][8]

六、常见误区:世界模型不等于万能模型

误区一:世界模型 = 视频生成模型。事实上,视频生成只是结果表现的一部分;真正关键的是动作条件下的环境演化与状态一致性。

误区二:世界模型 = AGI。它是通往更强 AI 的关键组成,不代表一旦做出世界模型就自动等于通用智能。

误区三:只要画面逼真就说明世界理解到位。当前研究越来越强调物理一致性、状态级理解和任务绩效,而不是只看像素好不好看。[11]

误区四:世界模型已经可以直接替代真实世界。现阶段它更适合作为训练、推演、验证和交互式原型工具,而不是无条件替代现实测试。

七、未来几年值得重点观察什么?

第一,世界模型会不会从“可生成”走向“可验证”。也就是说,不只是会产出环境,还要能对环境规则、因果关系和物理约束进行更可靠的评估。

第二,世界模型会不会成为智能体与具身系统的基础设施。未来 agent 调度、工具调用、机器人控制,很可能都需要某种形式的“内部世界模拟器”。

第三,二维视频世界模型会不会进一步升级为稳定的 3D / 4D 世界表征。空间智能、持久世界和交互式环境,是这条路线的自然延伸。[9][10]

第四,评估标准会不会重写。按照最新综述,世界模型仍缺统一数据集、统一指标和长期一致性的可靠评估框架,这会直接决定产业落地速度。[11]

八、结语

如果说上一阶段的大模型革命,核心是让机器学会“表达”;那么世界模型所代表的下一阶段,更像是让机器开始学会“在世界中工作”。它让 AI 从静态回复走向动态模拟,从单步输出走向多步行动,从内容生成走向环境生成。也正因为如此,世界模型才会被越来越多的人视作下一代 AI 方向。它未必会以“世界模型”这个名字统一收口,但它所代表的能力——理解状态、预测变化、支持规划——几乎肯定会成为未来 AI 系统的底层竞争力。

FAQ:关于世界模型,最常见的 6 个问题

1. 世界模型和大模型是什么关系?

大模型更像通用认知底座,世界模型更像针对环境动态与行动结果的专门能力层。两者不是替代关系,而是越来越倾向于融合。

2. 世界模型是不是一定要生成视频?

不一定。视频只是外显形式,关键在于是否能对状态、动作和结果建立可用的预测结构。

3. 它和数字孪生是一个东西吗?

不完全一样。数字孪生偏向对具体对象或系统做高保真映射;世界模型更强调学习一般化环境规律与可行动模拟。

4. 为什么机器人行业这么在意世界模型?

因为机器人面对的是连续、开放、带物理约束的真实世界,没有环境建模就很难可靠行动。

5. 现在普通内容创业者有必要关注吗?

有必要。即使不做机器人,交互式内容、游戏、教育、3D 创作、短视频场景生成,都会受世界模型路线影响。

6. 未来会不会出现“会聊天、会看图、会操作、会进世界”的统一模型?

很可能会。行业正在朝多模态 + 智能体 + 世界模型 + 执行系统的融合方向前进。

参考资料

[1] Google DeepMind, Project Genie / What is a world model?, 2026. https://blog.google/innovation-and-ai/models-and-research/google-deepmind/project-genie/ ; https://blog.google/company-news/inside-google/googlers/ask-a-techspert/what-is-a-world-model-project-genie/

[2] Google DeepMind, Genie 2: A large-scale foundation world model, 2024. https://deepmind.google/blog/genie-2-a-large-scale-foundation-world-model/

[3] Google DeepMind, Genie 3: A new frontier for world models, 2025. https://deepmind.google/blog/genie-3-a-new-frontier-for-world-models/

[4] Google DeepMind, Genie model page, 2025-2026. https://deepmind.google/models/genie/

[5] Meta AI, V-JEPA 2: Self-Supervised Video Models Enable Understanding, Prediction, and Planning, 2025. https://ai.meta.com/research/publications/v-jepa-2-self-supervised-video-models-enable-understanding-prediction-and-planning/

[6] NVIDIA Technical Blog, Advancing Physical AI with NVIDIA Cosmos World Foundation Model Platform, 2025. https://developer.nvidia.com/blog/advancing-physical-ai-with-nvidia-cosmos-world-foundation-model-platform/

[7] NVIDIA Blog, Why World Foundation Models Will Be Key to Advancing Physical AI, 2025. https://blogs.nvidia.com/blog/world-foundation-models-advance-physical-ai/

[8] NVIDIA Technical Blog, Scale Synthetic Data and Physical AI Reasoning with NVIDIA Cosmos World Foundation Models, 2026. https://developer.nvidia.com/blog/scale-synthetic-data-and-physical-ai-reasoning-with-nvidia-cosmos-world-foundation-models/

[9] World Labs, Homepage / About Spatial Intelligence, 2025-2026. https://www.worldlabs.ai/

[10] World Labs, Research & Insights, 2025-2026. https://www.worldlabs.ai/blog

[11] Xinqing Li et al., A Comprehensive Survey on World Models for Embodied AI, arXiv:2510.16732, 2025. https://arxiv.org/abs/2510.16732

[12] Google DeepMind, Gemini Robotics brings AI into the physical world, 2025. https://deepmind.google/blog/gemini-robotics-brings-ai-into-the-physical-world/

[13] Google DeepMind, Gemini Robotics 1.5 brings AI agents into the physical world, 2025. https://deepmind.google/blog/gemini-robotics-15-brings-ai-agents-into-the-physical-world/