小白必看:如何在Windows / Mac 上配置Python 与GPU 加速环境(含CUDA / MPS)

给本地部署新手的一份保姆级说明书:先理清 Python、venv、驱动、CUDA、MPS 的关系,再决定你的安装路线。

| 适合人群 Windows / Mac 新手 | 核心对象 Python、PyTorch、CUDA、MPS | 主分类 保姆级教程 > 环境配置教程 |

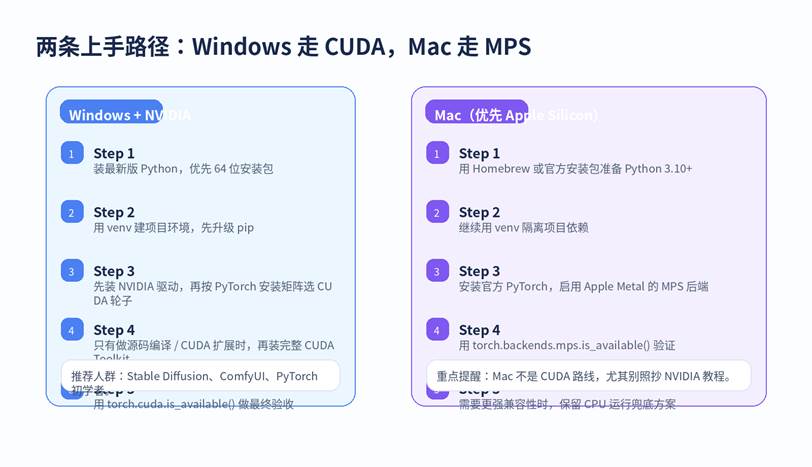

| 先说结论 Windows 的 GPU 加速主线通常是 “NVIDIA 驱动 + 正确的 PyTorch CUDA 轮子”,只有在你要编译自定义 CUDA 扩展或源码时,才必须额外安装完整 CUDA Toolkit。Mac 的 GPU 加速则基于 Apple Metal / MPS,而不是 CUDA。 |

一、为什么很多人一上来就把环境装乱了?

对新手来说,“Python 环境”这四个字经常被误解成只要装一个 Python 就结束了。实际上,本地跑 AI 工具时至少会涉及六层:硬件、驱动/系统、Python 解释器、虚拟环境、框架依赖、应用层。任何一层错位,都会表现成安装失败、包冲突、显卡不可见、启动就报错等问题。

因此,这篇教程不主张“见教程就照抄命令”,而是先把关系图和路线图讲清楚。你只要先判断自己属于哪一条路径,后面的命令反而会变得非常简单。

图:新手最容易混淆的并不是某一条命令,而是每一层到底在解决什么问题。

二、先判断你属于哪条路线

| 平台 | 推荐加速后端 | 一句话判断 |

| Windows + NVIDIA | 首选 CUDA | 能跑 PyTorch CUDA、Stable Diffusion、ComfyUI,本地 AI 生态最成熟。 |

| Mac + Apple Silicon | 首选 MPS | 走 Apple Metal 后端,适合轻量训练、推理和常见开发实验。 |

| Mac + Intel | 以 CPU 为主 | 不建议按 CUDA 教程配置;多数 AI 本地项目体验有限,优先考虑云端或外置方案。 |

判断原则其实非常直接:你是什么显卡,就走什么后端。不要把 NVIDIA 的 CUDA 术语,原样搬到苹果芯片设备上。

图:同样是“配置 Python 环境”,Windows 和 Mac 的核心分叉点在 GPU 后端。

三、Windows 路线:Python + venv + NVIDIA 驱动+ PyTorch CUDA

1)先装 Python,不要跳过基础设置

去 Python 官方下载 64 位安装包。对大多数 AI 工具用户来说,优先选择主流稳定分支即可;到 2026 年,Python 官网下载页已经列出 Python 3.13.13 为最新 3.13 系列版本,而 PyTorch 当前稳定版要求 Python 3.10 或更高。

- 安装时勾选 “Add python.exe to PATH”,避免后续终端找不到 python。

- 不要把一堆 AI 项目都装在系统全局 Python 里,后面一定会冲突。

- 如果你要跟着某个项目 README 指定版本走,以项目要求为准。

2)每个项目单独建一个虚拟环境

Python 官方 venv 文档明确指出,虚拟环境会把项目依赖隔离在单独目录里,默认与基础 Python 环境隔离。对于 ComfyUI、A1111、训练脚本、爬虫脚本并存的用户,这一步不是可选项,而是避免灾难的最低成本做法。

| py -V py -m venv .venv .venv\Scripts\activate python -m pip install –upgrade pip |

3)什么时候需要 NVIDIA 驱动?什么时候需要 CUDA Toolkit?

这是最关键的一段。驱动负责让系统和显卡正常通信;CUDA Toolkit 则是给开发者做编译、调试和 CUDA 开发用的完整工具链;而多数新手真正安装的是 PyTorch 官方提供的预编译轮子。也就是说,很多“跑模型”的场景并不需要你先手工配一整套 CUDA 编译环境。

| 最实用的判断法 如果你的目标只是运行官方 PyTorch、Stable Diffusion WebUI、ComfyUI 或常见推理项目,先装驱动,再按 PyTorch 官方安装矩阵选择对应 CUDA 轮子;只有在你明确要编译自定义 CUDA 扩展、从源码构建或依赖 nvcc 时,才安装完整 CUDA Toolkit。 |

4)PyTorch 安装建议:先以官方安装矩阵为准

PyTorch 官方首页当前显示,最新稳定版为 2.7.0,要求 Python 3.10+,并提供 CUDA 11.8、12.6、12.8 和 CPU 等安装选项。最稳的做法不是记命令,而是每次都去官方 selector 选出与你系统匹配的命令。

| python -m pip install torch torchvision torchaudio python -c “import torch; print(torch.__version__)” python -c “import torch; print(torch.cuda.is_available())” |

5)哪些场景必须安装完整 CUDA Toolkit?

PyTorch 官方 cpp_extension 文档写得很明确:如果你在运行时加载 CUDA 扩展,就需要额外安装对应 CUDA Toolkit(包括 nvcc 及其依赖),因为这些编译工具并不会随着 torch 一起安装。换句话说,普通推理用户和二次开发用户的需求并不一样。

| 场景 | 是否装 Toolkit | 说明 |

| 只跑官方 PyTorch / 常见推理 | 通常不用 | 优先安装驱动 + 官方 CUDA 轮子 |

| A1111 / ComfyUI 常规使用 | 通常不用 | 除非插件明确要求源码编译 |

| 编译 xFormers / 自定义扩展 | 需要 | 要有 nvcc、编译工具链和匹配版本 |

| 从源码构建 PyTorch / 插件 | 需要 | 还要注意 Visual Studio 编译器兼容 |

6)Windows 完成后的验收清单

- 终端执行 python –version 或 py -V 能返回正确版本。

- 激活 .venv 后,pip list 只显示当前项目依赖。

- import torch 不报错,torch.cuda.is_available() 返回 True。

- 模型或项目首次启动不会再提示“找不到 Python / CUDA / torch”。

四、Mac 路线:Python + Homebrew + venv + PyTorch MPS

Mac 这条线最大的误区,是把“CUDA 教程”当成通用教程。苹果设备的 GPU 加速主线是 Metal / MPS。Apple Developer 页面明确说明,PyTorch 在 Mac 上使用的是 Metal Performance Shaders(MPS)后端,用来做 GPU 训练和推理加速。

1)先明确你的机器类型

- Apple Silicon(M1 / M2 / M3 / M4):优先走 MPS 路线。

- Intel Mac:多数情况下以 CPU 为主,不建议期待 CUDA 体验。

2)Homebrew 的价值是什么?

Homebrew 并不是必须的,但非常适合新手统一管理 Python、git、ffmpeg、cmake 等开发组件。Homebrew 文档也明确给出默认安装前缀:Apple Silicon 在 /opt/homebrew,Intel Mac 在 /usr/local。这个细节很重要,因为后续 PATH 和命令路径基本都围绕它展开。

| /bin/bash -c “$(curl -fsSL https://raw.githubusercontent.com/Homebrew/install/HEAD/install.sh)” brew –version brew install python |

3)Mac 上也要用 venv

很多人误以为“Mac 比 Windows 稳定,所以可以不建虚拟环境”。其实项目隔离和系统稳定是两码事。只要你会同时装多个 AI 项目,venv 仍然是最省事的隔离方式。

| python3 -V python3 -m venv .venv source .venv/bin/activate python -m pip install –upgrade pip |

4)PyTorch MPS 验证方法

PyTorch 与 Apple 的资料都给出了统一方向:在支持的 Mac 上,PyTorch 可以通过 mps 设备把运算交给 Apple GPU。你真正需要确认的,不是“有没有 CUDA”,而是 “MPS 是否可用”。

| python -m pip install torch torchvision torchaudio python -c “import torch; print(torch.backends.mps.is_available())” python -c “import torch; print(torch.device(‘mps’) if torch.backends.mps.is_available() else “cpu”)” | |

| Mac 用户的底线认知 当教程里出现“安装 CUDA Toolkit”“配置 nvcc”“NVIDIA 驱动版本兼容”时,你就应该先停一下:这大概率不是给 Apple Silicon 新手写的。 | |

五、通用建议:无论Windows 还是Mac,都先把这5 件事做好

| 动作 | 原因 |

| 固定项目目录 | 把不同 AI 项目分别放进独立文件夹,别混装。 |

| 统一环境名 | 每个项目都叫 .venv,后续脚本最容易复用。 |

| 先升级 pip | 大量依赖问题只是因为 pip 太旧。 |

| 先做最小验证 | 先验证 import torch,再跑大项目,排错更快。 |

| 记录版本 | 把 Python、torch、驱动、插件版本写进 README 或 requirements。 |

六、最常见的报错与处理思路

| 现象 | 高概率原因 | 优先处理 |

| python 不是内部或外部命令 | PATH 没配好或安装后未重开终端 | 重新安装时勾选 PATH,或改用 py / python3 调用 |

| torch.cuda.is_available() = False | 驱动未装好、装成 CPU 轮子、环境没激活 | 确认 NVIDIA 驱动、确认当前 .venv、重装正确 wheel |

| Mac 上找 CUDA 教程越看越乱 | 路线本身错了 | 切回 MPS 思路,不再追 CUDA |

| pip 安装依赖编译失败 | 缺编译工具或版本不匹配 | 看项目 README,补齐 C++/CUDA 工具链 |

| 一个项目能跑,另一个项目直接崩 | 全局包污染 | 为每个项目重新创建 .venv |

七、给真正的新手的推荐打法

如果你只是想尽快开始,而不是研究环境细节,最稳妥的顺序其实非常简单:

- Windows 用户:先装 Python -> 建 .venv -> 装 NVIDIA 驱动 -> 按 PyTorch 官方矩阵安装 -> 验证 torch.cuda.is_available()。

- Mac 用户:先装 Python / Homebrew -> 建 .venv -> 装 PyTorch -> 验证 torch.backends.mps.is_available()。

- 只有当项目明确提示需要源码编译、CUDA 扩展或 nvcc 时,再进入 CUDA Toolkit / 编译器那一层。

这套顺序的核心,不是“少装东西”,而是“先跑起来,再逐层加深”。对新手来说,过早进入编译工具链,只会把简单问题变成复杂问题。

FAQ

1. 我只想跑 Stable Diffusion WebUI,需要先装完整 CUDA 吗?

大多数情况下不需要。先确认显卡驱动正常,再按项目文档安装依赖;只有在插件或扩展要求源码编译时,才考虑补装 CUDA Toolkit。

2. Mac 能不能装 CUDA?

对当下主流 Apple Silicon 用户来说,重点不在“能不能折腾 CUDA”,而在于生产可用的 GPU 加速路线已经是 MPS。照着 NVIDIA 教程配置,通常只会增加排错成本。

3. 为什么我明明装了 torch,还是检测不到显卡?

先排查你装的是不是 CPU 版轮子、当前终端是否激活了正确的 .venv、NVIDIA 驱动是否正常,再看项目是否 actually 使用 GPU。

4. Python 版本是不是越新越好?

不一定。最新版本代表新特性,但项目兼容性优先。最稳妥的办法,是优先遵循目标项目 README 或官方安装矩阵。

5. 一个电脑里可以装多个 Python 版本吗?

可以,而且很常见。关键不是“只能有一个版本”,而是每个项目要知道自己到底绑定哪一个解释器。

6. 新手更推荐 Windows 还是 Mac?

如果目标是本地 AI 绘图、训练、插件生态,Windows + NVIDIA 兼容性通常更强;如果目标是轻量开发、脚本、日常 AI 工具整合,Apple Silicon + MPS 会更省心。

相关阅读

- 本地部署入门:手把手带你下载 Stable Diffusion WebUI 整合包

- 从零开始:使用 Flux 1.0 生成超写实摄影大片的参数指南

- 如何利用 Claude 4 编写高质量的代码?

- Notion AI 深度集成:打造你的个人智能知识库

本文采用的主要公开资料

- Python 官方下载页与 venv 文档

- PyTorch 官方首页、Get Started 安装矩阵、cpp_extension 文档

- NVIDIA CUDA Windows Installation Guide

- Apple Developer: Accelerated PyTorch training on Mac (Metal / MPS)

- Homebrew 官方 Installation 文档