本地部署大模型保姆级教程:从概念到实操

适合 0 基础用户的一篇入门实操文:先弄懂概念,再按步骤把模型真正跑起来。

定位:保姆级教程|适用平台:Windows / macOS / Linux|核心工具:Ollama、LM Studio、Open WebUI

很多人第一次接触“本地部署大模型”,会被一堆词吓住:参数量、量化、GGUF、显存、上下文、RAG、WebUI……其实把它拆开看,本质上只有三件事:

• 选一个适合你电脑的模型。

• 用一个能把模型跑起来的工具。

• 用一个你顺手的界面去和模型交互。

| 这篇会帮你得到什么 • 读完以后,你能分清“模型”“运行引擎”“聊天界面”分别是什么。 • 你会知道自己的电脑适合从哪一档模型开始,而不是盲目追大模型。 • 你能用一套最小可行流程,把本地模型真正跑起来,并完成首轮测试。 |

一、先搞懂:为什么很多人要把大模型放到本地

本地部署最吸引人的地方,不是“更酷”,而是更可控。模型在你自己的机器上运行,资料不用上传到第三方平台,离线也能用,很多定制化玩法也更自由。

当然,本地部署也不是万能。它通常会牺牲一部分效果、速度或易用性;如果你的电脑配置一般,又想直接获得最强能力,云端模型往往更省事。

所以更准确的判断方式是:如果你看重隐私、稳定、可玩性,或者你想自己搭建知识库、个人助手、写作环境,那本地部署很值得学。

| 适合本地部署的人 • 希望处理个人笔记、合同、方案、代码等私有资料。 • 经常做固定类型任务,想长期优化自己的 AI 工作流。 • 愿意为可控性和长期成本,接受一部分折腾成本。 |

| 不必勉强本地部署的人 • 只是偶尔问问题,对私有数据和离线能力没有要求。 • 电脑配置很低,又期待“开箱即用 + 最强效果”。 • 短期目标只是提高效率,暂时不想碰环境和排错。 |

二、新手必须先懂的 6 个核心概念

| 概念 | 新手能听懂的解释 |

| 模型 | 你真正要运行的 AI 大脑,本体通常是一个或多个权重文件。 |

| 参数量 | 常见会看到 3B、7B、14B、32B 等。参数量越大,通常理解和生成能力越强,但占用资源也越多。 |

| 量化 | 把模型压缩成更省资源的版本。新手最常接触的是 4-bit 或 5-bit 量化,效果略降,但更容易在个人电脑上跑起来。 |

| 上下文长度 | 模型一次能看进去多少内容。你喂给它的系统提示、对话历史、文档片段,都在消耗上下文。 |

| 运行引擎 | 负责把模型真正加载并执行的程序,比如 Ollama、llama.cpp、LM Studio。 |

| 交互界面 | 你和模型对话的窗口,比如 Open WebUI、Chatbox、AnythingLLM。 |

图 1:把本地部署理解成“目标—硬件—模型—工具—验证”的五步流程,会容易很多。

三、先选路线:你的电脑适合跑什么规模的模型

新手最容易踩的坑,就是一上来追“大而全”,结果下载半天、启动失败、速度还很慢。更稳妥的做法是:先跑通,再升级。

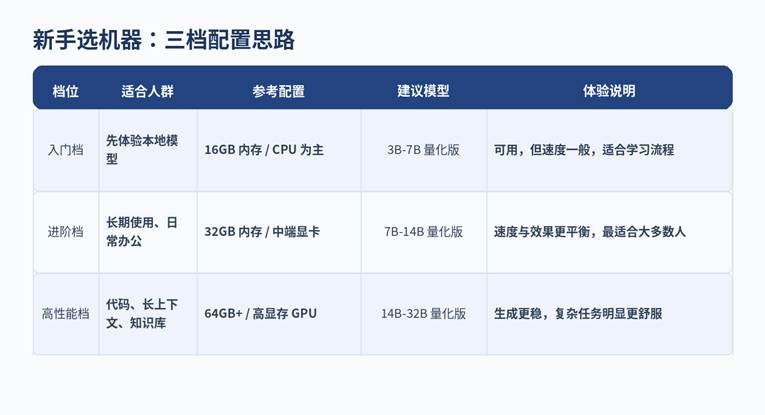

图 2:三档机器配置思路。绝大多数新手,进阶档已经足够舒服。

选模型时,可以优先遵循这三个判断顺序:

• 先看你要做什么:通用对话、写作润色、代码辅助、知识库问答,侧重点不同。

• 再看你的机器能不能稳跑:能跑起来比理论最强更重要。

• 最后再比较口碑:社区常见推荐是参考,但不是唯一标准。

| 给新手的模型选择建议 • 第一次上手:优先选择 7B / 8B 的通用中文模型或中英双语模型。 • 电脑一般:优先选 GGUF 量化版,这类模型更适合本地推理。 • 如果你主打知识库:先关注稳定性和指令跟随,不要只盯着 benchmark。 |

四、工具怎么选:Ollama、LM Studio、Open WebUI 到底是什么关系

把这几个工具放在一张图里,你就不容易混了:

图 3:模型文件本身不等于聊天界面,中间还隔着运行引擎。

| 工具 | 定位 | 优点 | 更适合谁 |

| Ollama | 运行引擎 | 安装简单、命令直观、资料多 | 想用最短路径把模型跑起来的人 |

| LM Studio | 桌面客户端 | 图形界面友好、下载模型方便 | 更喜欢可视化操作的新手 |

| Open WebUI | Web 聊天界面 | 接近在线聊天体验,便于管理 | 想长期使用本地 AI 的用户 |

| AnythingLLM | 知识库 / 工作台 | 更偏文档问答与工作流 | 想做本地知识库的人 |

如果你问我“新手最稳的一条路线是什么”,我通常会建议:

• 先用 Ollama 跑通模型,再按需要补 Open WebUI。这样既容易理解结构,也便于后续扩展。

五、正式实操:用最小可行流程把模型跑起来

下面这套步骤不是唯一方案,但它对新手足够稳,重点是“先跑通,再优化”。

步骤 1:安装运行引擎

先安装 Ollama。安装完成后,终端里能调用 ollama 命令,就说明引擎已经就位。

步骤 2:拉取一个适合新手的模型

第一轮建议选择 7B / 8B 左右的通用模型,不要一上来追求最大。

步骤 3:先做一次命令行对话

命令行能对话,说明模型和引擎链路已经打通。

步骤 4:再接一个图形界面

想要更接近在线聊天的体验,可以接 Open WebUI 或其他桌面聊天工具。

步骤 5:保留你的首个测试提示词

以后模型换了、环境变了,都可以用同一组测试提示词做基准对比。

常见命令示例(以 Ollama 思路为例):

ollama list

ollama pull <模型名>

ollama run <模型名>

ollama ps

| 第一次测试时,建议直接问这 3 类问题 • 一个简单事实问题:验证模型是否能稳定作答。 • 一个结构化输出问题:验证它能否按列表、表格思路回答。 • 一个贴近你真实工作的任务:验证它是不是“对你有用”,而不是只是“会聊天”。 |

六、如何判断“跑起来了”而不是“看起来像跑起来了”

✓ 终端或界面里能够稳定返回完整回答,而不是立即报错或卡死。

✓ 连续追问两三轮以后,上下文仍然能接得住,不是每次都像“重新开机”。

✓ 模型回答速度在你能接受的范围内;如果一段很短的话也要等很久,后面体验会很差。

✓ 中文输出基本正常,没有大量乱码、断句异常或明显失真。

| 一套通用测试提示词模板 • 请先用 80 字解释你是什么模型、适合做什么。 • 请把“本地部署大模型的准备步骤”整理成 5 条清单。 • 假设我是新手,请用尽量少的术语解释什么是量化模型。 • 我给你一段文本后,请提炼要点并输出成表格。 |

七、想更好用:再往前走一步,把界面和知识库接上

当你已经能稳定聊天以后,下一步通常有两个方向:

• 装一个更顺手的界面,让日常提问更像用在线聊天工具。

• 接入文档和知识库,让模型不只是“会说”,而是能基于你的资料回答。

做知识库时,很多人会误以为“把 PDF 丢进去就完了”。其实真正影响效果的,是文档清洗、切片方式、召回策略和提示词结构。

知识库接入的最小思路

• 先选少量、干净、结构清晰的文档做测试。

• 先看模型能不能引用到正确段落,再追求答案写得漂亮。

• 当回答不准时,优先查数据链路,而不是先怪模型“太笨”。

八、最常见的报错和排查思路

本地部署不像在线工具那样“点开就用”,排错能力本身就是入门的一部分。你不用一次学会所有细节,但至少要有一个判断顺序。

图 4:出现问题时,不要乱试。先分辨是“资源问题”“配置问题”还是“提示词问题”。

实操时可以按这个顺序排查:

1. 先看资源:内存、显存、磁盘空间是否够。

2. 再看链路:模型名、端口、API 地址是否填对。

3. 再看任务:是不是把一个小模型硬当“全能专家”来用。

4. 最后看提示:有没有给清楚身份、目标、格式和限制条件。

九、给新手的 5 条真心建议

1. 不要拿第一轮效果给本地部署判死刑。模型选错、提示词太空、知识库链路没调好,都会让效果看起来比实际更差。

2. 别迷信“参数越大越好”。适合你电脑、适合你任务、能长期用,才是真正的好模型。

3. 把“首个稳定版本”记录下来。包括模型名、量化版本、上下文设置、测试提示词,后续升级才有对照。

4. 多做小步验证。每次只改一个变量,排错速度会快很多。

5. 如果你的目标只是提高效率,不必排斥云端模型;本地与云端,完全可以混合使用。

FAQ|常见问题

Q1:没有独显,可以本地部署大模型吗?

可以,但体验会受限。没有独显并不代表完全不能用,只是更适合从小模型、量化模型开始,速度也通常会慢一些。

Q2:本地部署是不是一定比在线模型更强?

不是。本地部署的优势主要在隐私、离线、可控和可玩性,不在于“默认最强”。

Q3:新手第一套组合怎么选更稳?

优先选择 7B / 8B 左右的量化模型,先用 Ollama 跑通,再视需求加 Open WebUI。

Q4:为什么我已经跑起来了,但回答还是不理想?

常见原因有三个:模型不适合任务、提示词不清楚、知识库链路没调好。先分开排查,不要一锅端。

Q5:本地部署后能做哪些实用场景?

最常见的是私有资料问答、写作润色、笔记整理、代码辅助、个人知识库和固定流程自动化。

Q6:我应该先学哪一块,才不会越学越乱?

先学结构,再学工具。也就是先弄清“模型—运行引擎—交互界面”三层关系,再装具体软件。

结论:本地部署大模型并不难,难的是一开始把概念和路径理顺。只要你先跑通最小闭环,再一点点叠加,门槛就会快速下降。