Microsoft MAI 模型:Foundry

微软自研模型家族与 Foundry 平台的完整拆解

适合对象:关注模型选型、Azure 生态、企业级落地与 Agent 开发的开发者 / 产品 / 内容团队

为什么这篇值得看

最近这波 Microsoft MAI 模型的公开节奏很快,很多人一眼看过去会混淆:MAI 是不是一个单独产品?Foundry 到底是模型、平台,还是 Azure 里的新入口?如果概念没分清,后面看模型目录、部署方式、API 文档就很容易越看越乱。

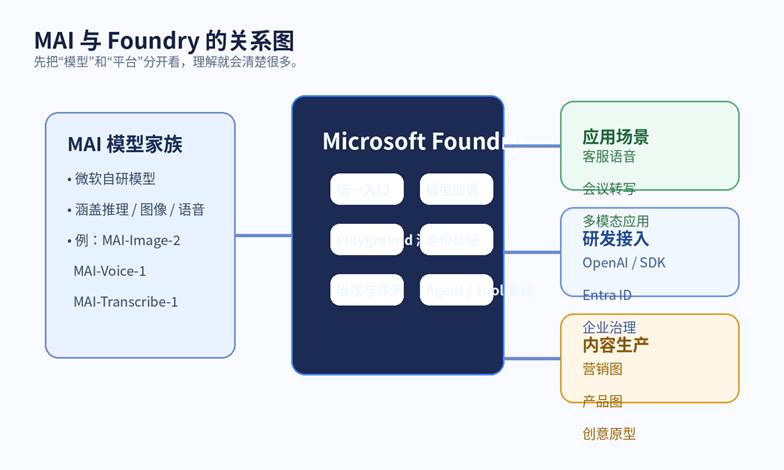

把它说透其实不难:MAI 更像是微软自研模型家族的品牌集合,而 Microsoft Foundry 则是微软现在面向 AI 应用与 Agent 开发的统一平台。模型在变多,平台在统一,真正值得关注的是两者组合后形成的完整开发路径。

这篇文章会从“概念解释、模型梳理、适合场景、上手步骤、常见误区”五个层面展开。你看完后,至少能回答三个关键问题:现在公开能见到哪些 MAI 模型、它们分别适合干什么、以及第一次上手 Foundry 应该从哪里开始。

| 三句话先看懂 MAI 是微软自研模型家族,Foundry 是统一的 AI 应用与 Agent 平台;当前公开关注度最高的 MAI 模型集中在图像、语音合成、语音识别三个方向;正式选型时,不只看发布新闻,还要同步核对模型目录、生命周期状态和区域可用性。 |

一、先分清两个概念:MAI 与 Foundry 不是一回事

先说 MAI。按照微软近期公开资料的表述,MAI 可以理解为 Microsoft AI 旗下的一组第一方模型家族。你会在官方资料里看到 MAI-Image-2、MAI-Voice-1、MAI-Transcribe-1 等命名方式,它们分别对应图像生成、语音合成和语音识别等能力。

再说 Foundry。Microsoft Foundry 官方文档给它的定位非常清楚:它是一个用于构建、优化和治理 AI 应用与 Agent 的统一平台,重点不是某一个模型本身,而是让开发者在一个入口里管理模型、Agent、工具、评测、安全与部署。

所以最容易记住的一句话是:MAI 是‘能力本体’,Foundry 是‘承载与编排这些能力的平台’。把这层关系理顺后,你再看“模型目录”“Playground”“Agents”“Tools”“Projects”这些名词,就不会混在一起了。

图 1:把“模型家族”和“平台能力”拆开看,Foundry 的定位会更清晰。

二、截至 2026 年 4 月,公开资料里值得重点关注的 MAI 模型

目前最值得关注的公开型号,主要集中在 2026 年 4 月前后披露的这几类:一类是图像生成,另一类是语音输入输出,再加上一类较早出现但生命周期状态需要谨慎核对的推理模型。对新读者来说,不要试图一次记住所有文档名,先用“任务类型”去记,会轻松很多。

| 模型 | 能力类型 | 最适合的任务 | 阅读要点 |

| MAI-Image-2 | 图像生成 | 海报、营销图、产品视觉、创意草图 | 公开预览;支持在 Foundry 中部署与调用 |

| MAI-Voice-1 | 语音合成 | 长文本朗读、对话语音、播客配音、陪伴型产品 | 公开预览;强调表达力与长文本稳定度 |

| MAI-Transcribe-1 | 语音识别 | 会议转写、语音输入、客服录音转文本 | 公开预览;支持 25 种语言,但不支持 diarization |

| MAI-DS-R1 | 推理 / 分析 | 复杂推理、结构化分析、Agent 试验 | 生命周期页标注 retired,选型前必须核对当前目录 |

图 2:用“类型 + 场景 + 当前状态”三个维度,判断该从哪款模型切入。

三、每款模型到底适合做什么

1. MAI-Image-2:更适合内容生产与商业视觉

官方文档对 MAI-Image-2 的描述非常直接:它是一个文本生成图像模型,强调高质量、视觉丰富、对提示词有较强对齐能力,并明确点名了产品图、品牌素材、商业视觉和创意设计流程等场景。

这意味着它不是只适合“好玩”的海报图。更现实的用法包括:为电商详情页先做视觉草图、给广告团队快速做一版 KV 方向、给产品经理做页面概念图、给内容团队批量出封面候选图。对于做内容站或营销设计的人,这一点会非常实用。

从部署角度看,MAI-Image-2 目前走的是 Foundry 中的部署与图像生成 API 路径,适合希望在 Azure 体系内把图像生成接入现有应用或工作流的团队。

2. MAI-Voice-1:重点不是“能说话”,而是“说得像人”

MAI-Voice-1 属于神经语音合成模型,公开资料里强调的关键词不是单纯 TTS,而是 expressive、conversational、long-form。换句话说,它想解决的是“声音自然”“情绪更丰富”“长文本不容易崩”的问题。

如果你的场景只是简单播报通知,很多传统 TTS 已经够用;但如果你要做陪伴型 AI、对话式客服、角色语音、播客化内容、长文朗读,语音的表现力和人格一致性会直接影响产品体验,这时 MAI-Voice-1 才真正体现价值。

目前公开资料里还提到它提供 6 个美式英语预置声音,因此对于中文内容团队来说,短期更适合英文播客、英文旁白、海外市场语音应用。

3. MAI-Transcribe-1:转写准确率与成本效率是核心看点

MAI-Transcribe-1 是微软公开推出的语音识别模型,强调高准确率与高效率。官方文档给出了 25 种支持语言,并在限制项里明确提醒:当前不支持 diarization,也就是不适合把多人说话者自动区分这件事想得太理想化。

它更适合的场景包括:会议记录转写、语音输入转文字、客户通话归档、音频内容做文本底稿、AI 语音 Agent 的听写前处理。如果你的业务是“先听懂,再交给大模型总结”,那 MAI-Transcribe-1 的位置就很清楚了。

另一个值得注意的点是,微软对它的宣传不只讲准确率,也讲 GPU 成本效率。这对企业场景非常重要,因为语音识别一旦进入大规模调用,成本和吞吐会比 Demo 阶段敏感得多。

4. 关于 MAI-DS-R1:把它当成‘历史信号’比当成‘新入口’更合适

MAI-DS-R1 在 Foundry 的模型页面里仍然能看到名字,但生命周期页面又把它标记为 2026 年 2 月 27 日 retired。这个现象本身就说明一件事:在 Foundry 生态里,‘能看到模型名’不等于‘它仍然适合新项目继续选型’。

对新手来说,最稳妥的做法不是纠结这款型号本身,而是记住一个方法:凡是你要正式接入生产环境,至少同时核对模型目录、生命周期页面、区域可用性和 API 文档四项。这样比盯着一篇新闻稿更可靠。

四、为什么一定要把“模型”放到 Foundry 里理解

因为对开发者来说,真正难的往往不是“知道有这个模型”,而是“怎么把它稳定接到产品里”。Foundry 的价值就在这里:它不只给一个模型列表,还提供项目、部署、Playground、认证、治理、Agent、Tools 等一整套企业级开发路径。

另一层现实意义在于统一接口。Microsoft Foundry 的文档已经明确提醒开发者,从 2026 年起应尽量转向更稳定的 OpenAI/v1 路线和稳定版 OpenAI SDK,而不是继续依赖将退役的 Azure AI Inference beta SDK。对团队来说,这意味着后续代码迁移和多模型切换都会更顺。

再往前一步说,Foundry 还是一个治理入口。很多团队最终会同时使用微软自己的模型、Azure OpenAI 模型,甚至第三方模型;平台统一后,权限、项目、评测、成本追踪和安全策略才有可能放在一套框架里管理。

| 实操提醒 如果你是第一次进 Microsoft Foundry,最容易踩的坑有两个:第一,把模型名当成最终可直接调用的 endpoint;第二,只看 Playground 能不能跑,不检查部署方式、区域与权限。前者会让你写错代码,后者会让你在团队协作时频繁卡权限。 |

五、新手怎么上手:建议照这个顺序走

- 先确认你要解决的任务类型。是想做图像生成、语音输出、语音识别,还是更通用的聊天 / 推理?先从业务问题倒推模型,而不是先爱上一款模型名。

- 进入 Microsoft Foundry,创建项目与资源。把环境先搭起来,保证后面 Playground、部署和权限都在同一个上下文里。

- 在模型目录或相关服务文档里确认模型状态。不要跳过“Preview / GA / retired / region”这些信息,它们会直接决定你能不能正式上线。

- 先在 Playground 或官方示例里跑通最小闭环。比如 MAI-Image-2 先用一条提示词出图,MAI-Voice-1 先用一段文本转语音,MAI-Transcribe-1 先转一段真实音频。

- 再决定调用路径。文本 / 多模型调用优先考虑 Foundry 的 OpenAI/v1 与稳定 SDK;语音类模型则按 Speech / Foundry Tools 文档走对应 API。

- 最后才是工作流整合:把模型接进你的内容生产、客服、会议纪要、营销设计或 Agent 流程里,同时补上权限、日志、成本与失败重试。

六、怎么选:四个真实场景帮你快速判断

| 你的目标 | 优先看什么 | 更可能的选择 | 备注 |

| 批量做营销图 / 视觉稿 | 图像质量、风格稳定性、商用视觉适配 | MAI-Image-2 | 适合内容与设计生产线 |

| 做英文播客 / AI 角色配音 | 语音表现力、长文本稳定性、声音人格 | MAI-Voice-1 | 当前更偏英文场景 |

| 会议 / 访谈转文字 | 多语言支持、识别准确率、成本效率 | MAI-Transcribe-1 | 当前不支持说话人分离 |

| 想统一管理多模型与 Agent | 平台能力、治理、接口统一 | Microsoft Foundry | 这是平台选择,不是单模型选择 |

七、最容易踩的 6 个误区

- 把 MAI 当成一个单独应用,而不是模型家族。

- 把 Foundry 当成“另一个模型”,忽略它的平台属性。

- 看到新闻就默认可以立刻商用,不核对 preview、region、role 与配额。

- 以为所有 MAI 模型都走同一套 endpoint,结果把 Speech 模型和一般模型调用混用。

- 只关注输出效果,不看企业里更关键的权限、认证、治理与成本。

- 继续沿用即将退役的 beta SDK,而不是尽早迁到 OpenAI/v1 与稳定 SDK。

八、我的判断:这篇新闻背后真正重要的信号是什么

如果只把这件事理解成“微软又发了几个模型”,那就低估了它的意义。更重要的信号是:微软正在把自己的第一方模型能力,越来越系统地装进 Foundry 这个统一平台里,让开发者在企业级治理框架下做图像、语音、Agent 和多模型协同。

这对开发者意味着两件事。第一,未来选型不会再只是比较单个模型跑分,而是比较“模型 + 平台 + 工作流”的整体效率;第二,如果你的团队本来就在 Azure 体系里,Foundry 很可能会变成比单独试模型更重要的长期入口。

所以,这篇文章的结论不是“某个 MAI 型号一定最强”,而是:从现在开始,理解 Microsoft Foundry 的平台结构,会比单独追一两款模型名字更重要。模型会变,平台路线更能决定你后面接入、治理和扩展的难度。

FAQ:关于 Microsoft MAI 与 Foundry 的常见问题

1. MAI 是不是和 Phi 一样,都是微软自研模型?

可以这样理解:它们都属于微软模型方向,但定位不完全一样。Phi 更偏大家熟悉的轻量语言模型路线;MAI 这波公开信息里,更强调微软自研的多模态与语音能力进入 Foundry。

2. Foundry 是不是 Azure AI Foundry 改名后的新说法?

现在官方文档与产品页已经普遍使用 Microsoft Foundry 这一命名,并把它定位成统一平台。实际使用时,你会看到它承接了过去 Azure AI Studio / Azure AI Foundry 的很多能力与入口。

3. 现在最值得先试哪一款 MAI 模型?

如果你做内容设计,先看 MAI-Image-2;如果你做英文语音交互或长文本朗读,先看 MAI-Voice-1;如果你做会议纪要、语音输入或转写,先看 MAI-Transcribe-1。

4. MAI-Transcribe-1 能不能直接拿来做多人会议分角色转写?

当前公开文档明确写了不支持 diarization,所以它更适合先做高质量转写,再由后续流程或其他组件处理说话人识别。

5. Foundry 里的模型是不是都能用同一套 SDK?

方向是越来越统一,但不是所有能力都完全一模一样。通用模型接入会明显向 OpenAI/v1 和稳定 SDK 收敛;语音类能力仍要按对应服务文档走。

6. 做生产环境接入时,最先检查什么?

按这个顺序检查最稳:模型状态、区域、权限角色、部署方式、认证方式、接口文档、成本与日志策略。

相关阅读

• n8n、Dify、Coze 是什么?自动化工作流入门教程

资料说明

本文基于截至 2026 年 4 月初微软公开资料整理,包括 Microsoft Foundry 官方文档、Foundry Models 官方文档、MAI-Image-2 / MAI-Voice-1 / MAI-Transcribe-1 官方说明,以及模型生命周期页面。

由于 Foundry 平台处于持续更新中,模型目录、区域支持、Preview / GA 状态与生命周期信息都可能发生变化;正式接入时,请以当日官方页面为准。